基于移动平台热成像的行人检测随机蕨分类器  下载: 1019次

下载: 1019次

1 引言

近年来,生活中各种各样的监控设施随处可见,如交通要道的违章拍摄电子眼,发电厂、油田等厂区的防爆产品等。根据需求的不断扩展,出现了以汽车、移动机器人、无人机等为平台的可移动监控设备,这些设备使监控更加灵活,其应用更加贴合生活。随着计算机视觉技术的不断发展,安防监控的内容也不再局限于对实际情况的简单摄录和查看,研究人员开始将精力更多地投入于对视频内容的自动化、智能化、高效化的处理和分析中,如行为检测、面部识别、密度检测、越界报警、轨迹跟踪等。傍晚至清晨为安防监控的重要时间段,该阶段受到人员密度低、监控人员警惕性下降、监控产品夜间拍摄效果不佳等因素的影响,成为交通事故、安全意外、犯罪事件的高发阶段。传统视频图像分析算法主要是基于可见光视频进行分析,并采用CCD摄像机进行视频采集。CCD摄像机价格低、技术成熟、产品丰富,但是其在低照度环境下拍摄的物体成像不清晰。此外,由于各种障碍物的遮挡及其与摄像机距离的不同,CCD摄像机拍摄出的行人图像会出现形变,这些都增加了分析的难度[1]。为了在低照度环境、宽阔视野下也能准确地检测出成像区域内的人员,并为其他算法如行为检测、越界报警等提供参考信息,本文选用红外热成像摄像机进行视频资料的摄录。

红外热成像摄像机可准确识别人体散发的热量[2],不受环境光照和行人姿态的影响,其售价也在逐渐降低,使研究成果的转化成为可能[3]。目前很多国内外研究人员利用红外热成像摄像机进行小目标的检测算法研究。针对拍摄环境、移动目标等问题,李思俭等[4]提出将运动模糊复原技术和图像增强技术引入红外胎侧系统;Li等[5]提出了利用 低成本传感装置优化动态环境下的目标检测;Dong等[6]利用视觉分析技术和空间滤波器进行海洋小目标检测;Deng等[7]基于局部权重差异测量的方式进行红外小目标检测。本文主要利用汽车或无人机搭载热成像设备进行视频拍摄[8],拍摄的目标物体大小适中,实际中对识别实时性的要求比准确性更高,故算法不宜复杂,并且应具有较高的稳健性。

利用热成像摄像机在低光照环境下对行人进行检测还存在一些难点,如相似亮度的建筑物、机动车、动物、电线杆等造成的分类干扰,存在多个行人成像重叠、极冷和极热物体周围的色圈、行人和背景之间不同气候环境下亮度的差异等[9]。分析安装于机动车上的摄像机采集的视频具有一定的挑战,因为相机的运动、行人外形的变化、复杂背景和实时性等要求都会影响算法的准确性。通过训练分类器实现图像或视频目标快速检测的方法得到了广泛使用,但是该方法需准备大量样本以进行分类器训练[10],工作量大且繁琐。此外,摄像头的安装角度及位置都会影响目标的成像姿态,研究人员很难准备完备样本集使其涵盖目标的所有表现形式,因此该方法难以保证不同成像条件下的目标检测稳健性。

本文对基于移动平台搭载热成像摄像机拍摄的视频进行分析,利用随机蕨分类器进行成像区域内的行人检测。将热成像摄像机安装于机动车车顶,首先拍摄少量监控视频,选出需要进行识别的行人区域(一个或多个),提取亮度特征及方向中心对称-局部二值模式(OCS-LBP)纹理特征并对其进行随机蕨分类器初始训练[11];该分类器应用于其他视频中进行行人检测时,将识别出的行人作为新的样本输入到分类器训练样本库中,同时更新分类器,以实现分类器的自主学习。该分类器训练方法能够提高训练速度、简化训练过程、减小样本采集复杂度,根据实际应用进行分类器专项场景自主训练,具有重要的研究及应用意义。在仿真阶段,选用了安装于无人机上的热成像摄像机拍摄的视频进行了空旷区域内的检测性能验证。由仿真结果可知,该方法可以获得较快的分类速度及较低的误检率,算法移植方便快捷,稳健性好。

2 基本原理

2.1 行人特征提取

热成像图片不能利用图像的色彩信息[12]。行人在热成像图片中呈现高亮度,并且个体间存在温度差异,因此可以利用亮度特征来区分热成像图片中的背景和行人。然而,因为环境中的其他物体(如路灯、机动车、动物等)的亮度比背景亮度高[13],行人检测如果只采用亮度信息,检测结果将会受到很大影响。

在行人检测中,纹理特征如梯度方向直方图(HOG)和局部二值模式(LBP)是用于区分背景及行人时普遍采用的特征[14-15]。近年来,LBP特征以其在光照度变化条件下稳健性佳、计算速度快和无需较多参数等优势,已经成功地应用于多种计算机视觉分析领域,如人脸识别、行人检测、行人跟踪等。最新的LBP特征为OCS-LBP特征,利用更低维度的特征信息可补充中心对称LBP特征丢失的方向及大小信息。

行人检测采用亮度特征与OCS-LBP特征相结合的方式。将行人框选区域划分为16块大小为4×4的互不重叠的子区域,从各个子区域中分别提取8维亮度信息,将提取出的特征值顺序整合为128维,并将其作为框选区域的亮度特征。OCS-LBP特征包含8维方向和大小信息,利用这些信息可以构建出每一个子区域的直方图。特征提取区域的OCS-LBP特征计算方法为:以区域内的某一个像素点为中心,选取半径为R的区域作为特征计算区域,计算该区域内每一个像素点的梯度方向,进而可获得该区域内所有像素点的相邻HOG[16-17]。直方图中的方向取值范围从0°~360°划分为8个角度,每个角度相差45°,所有子区域按顺序整合后可获得128维OCS-LBP特征。

2.2 随机蕨分类器

随机蕨用于分类,运用的数学知识主要为概率论。随机蕨分类器又称为半朴素贝叶斯分类器,是由贝叶斯分类器发展而来的。训练的过程是从样本特征到样本类别的映射。不同于随机森林算法,随机蕨算法学习的是类别的条件分布,随机蕨数量增加时,训练耗时呈线性增加,最终采用半朴素贝叶斯定理对目标进行分类,该算法易于理解和训练,分类速度快。

2.2.1 训练数据准备

给定带有类别信息的样本库S,S包括N个样本,可表示为S=(fN,CN),其中f为样本特征值,C为样本类别。f通常可表示为M维向量,第i个样本的特征值可表示为fi=(fi1,fi2,…,fiM),其中i∈{1,2,…,N};设类别数为K,则第i个样本的类别表示为Ci∈{c1,c2,…,ck},其中k∈{1,2,…,K};分类器H可实现f到C的映射。

随机蕨分类器从大小为M的特征集合中随机抽取R组大小相同的特征子集,每个子集从特征集合中随机选取b对特征进行二值测试,将得到的b对测试值作为特征子集的特征值,且b

式中Lt1表示随机选取的第t对特征值对的第1个特征值,Lt2表示随机选取的第t对特征值对的第2个特征值,t∈{1,2,…,b}。(1)式得到的特征值即为随机蕨分类器的训练样本特征值。

每个子集称为一个随机蕨,第j个随机蕨的特征值可表示为Fj={f'j,1,f'j,2,…,f'j,b},j∈{1,2,…,R},第j个随机蕨中第b个特征值可表示为f'j,b∈{0,1},该特征值可通过二值测试计算得到。

每个随机蕨特征值的选择过程为:从16个子区域中随机抽取两个子区域,并在抽取出的两个子区域各自的8维亮度特征中随机抽取1维特征进行二值测试,共进行5次抽取及测试,最终得到5个特征值;按照同样的方法,可以得到对应于OCS-LBP特征的5个特征值。这两组特征的顺序组合即为该随机蕨的最终特征值。

2.2.2 随机蕨分类器训练

随机蕨分类器训练主要分为以下两种:

1) 单个随机蕨分类器训练。由第2.2.1节的介绍可知,每个样本的第j个随机蕨的特征值Fj包含的特征值可形成一个b位二进制码,其对应的十进制数有2b种可能的数值。对于大量的同一类别样本(如c1),在特征集合中的相同位置获取b对特征值并进行二值测试,可获得相同随机蕨下的b位二进制码,统计这些二进制码的数值分布,即可获得该类别样本在该随机蕨中的后验概率P(Fj|c1)。对于其他类别ck,同样准备大量训练样本,计算其在Fj下的后验概率P(Fj|ck)。

2) 多个随机蕨分类器训练。如果将每一个随机蕨比作一个精通某一窄领域的专家,则多个随机蕨即为多个精通不同领域的专家。对于一个新的问题(测试样本),这些专家会用不同的角度去分析,进而得到不同的分析结果,最终将这些专家的分析结果进行整合,得到对这个问题的最终解答。显然,一个随机蕨对样本的分类精度不高,可以将多个随机蕨的分类结果进行整合,获得最终的分类结果,这就要求进行多个随机蕨分类器的训练及结果整合。假设多个随机蕨之间是条件独立的,则所有随机蕨对于某一类别的联合似然分布为

相应的随机蕨分类器利用半朴素贝叶斯方式求取最终分类结果,分类公式为

式中P(ck)为每个类别的先验概率,可通过训练集训练得到;argkmax为使得中括号内计算所得结果最大时k的取值。

2.2.3 测试样本分类

针对每一个未知分类的测试样本,计算该样本在不同随机蕨中的b位二进制码特征值,根据随机蕨中每一类的后验概率分布计算得到对应二进制码属于该类的概率,最大概率对应的类别即为各随机蕨对应该测试样本的分类结果。利用(3)式获得测试样本的最终分类结果。

样本分类置信度可表示为

2.3 分类器在线自主学习

随机蕨分类器的训练无需更新弱分类器权重及样本权重,只需统计每类训练样本在不同随机蕨中的后验概率分布,因此该分类器的训练速度较快[18]。此外,对于随机蕨分类器的在线学习也可通过更新后验概率分布实现。

这里主要探讨移动平台热成像的行人检测随机蕨分类器问题,检测的目标类别为行人与背景,需要准备正、负样本训练初始随机蕨分类器。首先人工选取行人类别待检测目标,对其进行旋转角度及缩放尺度变化的仿射变换,自动获取初始正样本集。通过在行人选框周边和图像边缘随机取样获得初始负样本。

分别提取正、负测试样本的亮度及OCS-LBP特征值,利用随机蕨分类器训练方法统计正、负样本在不同随机蕨不同特征值上的后验概率分布,以获得初始随机蕨分类器。

分类器的在线学习利用新增的正样本或负样本更新每个随机蕨的后验概率分布。设在线学习的样本为(fnew,ck),其中fnew为M维特征向量,且假设ck为正样本。以F1为例说明随机蕨分类器的在线学习过程:1) 计算该样本在F1中的b位二进制码特征值q;2) 将F1的特征值即q的正样本数NPOS加1,负样本数NNEG保持不变;3) 更新F1的后验概率分布,其中特征值为q的后验概率变为(NPOS+

1)/(NPOS+NNEG+1);4) 归一化F1的后验概率分布;5) 其他随机蕨重复步骤1)~4)进行分类器的后验概率分布更新。

随机蕨分类器的在线学习过程即统计各个随机蕨特征值对应的样本个数,并由样本个数的变化更新后验概率分布。由此可见,随机蕨分类器的在线学习速度远快于其他在线学习算法。

3 实验结果

运行环境为Intel®CoreTM i5-5200U CPU@2.20 GHz处理器,安装内存为8G。仿真视频资源选用启明大学跟踪数据库中的视频。该数据库中包括利用远红外摄像机拍摄的视频资料,摄像机的焦距为8 mm,水平视场角为50°,波长感知区间为8~13 μm,视频分辨率为640 pixel×480 pixel,摄像机安装于汽车车顶上方,汽车运动速度为20~30 km·h-1。拍摄的画面偶尔出现抖动,视频中会出现行人的运动、突然的形变和不确定的运动状态,行人会出现部分或全部的重叠。为了验证所提算法的分类性能,选用了5个视频序列的4614帧进行测试,

表 1. 启明大学视频序列

Table 1. Video sequences of Keimyung university

|

随机蕨分类器仿真步骤:

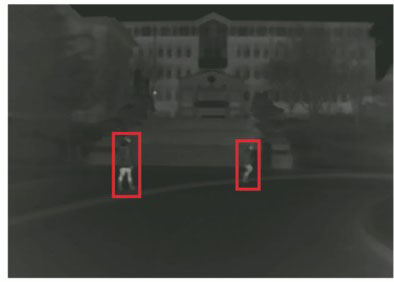

1) 在视频帧中框选全部行人子区域,如

2) 对正、负样本图片进行亮度特征及OCS-LBP特征提取,并对每张样本增加类别标注信息,分为行人类和背景类。

3) 选取的随机蕨个数为40,每个随机蕨包含的特征数为10(5个亮度特征,5个OCS-LBP特征),制作出用于训练分类器的正负样本特征库。

4) 计算各随机蕨的行人及背景类别的后验概率分布。

5) 任意框选已知类别的区域作为分类器性能测试样本。按照步骤1)~2)获取1380张正样本图片、1458张负样本图片,以及各样本的亮度、OCS-LBP特征。

6) 计算得到各样本的分类结果并与已知分类标签进行比较,获得分类器分类性能指标。

7) 将测试样本及分类结果输入到分类器训练样本库中,更新随机蕨分类器的后验概率分布,以提高分类器的分类准确度。

仿真中选用了无人机拍摄视频进行空中移动平台算法性能验证,并将仿真结果进行了比较。无人机拍摄的视频是利用无人机搭载热成像摄像机进行拍摄的。无人机型号为Yuneec台风Q500,飞行速度为25 km·h-1,悬停高度为20 m。热成像摄像机型号为FLIR-Vue,红外焦距为25 mm,水平视场角为25°,识别波长范围为7.5~14 μm,视频分辨率为640 pixel×480 pixel。仿真过程同上述步骤1)~7),视频帧图片如

4 分析与讨论

对所提方法与文献[

19-20]中两种方法的性能进行了比较,结果如

献[19]所述Harr特征的AdaBoost分类算法和文献[ 20]所述HOG特征的在线学习算法针对车载视频的误检率较本文算法分别低约0.44%及0.32%,但算法运算速度比所提算法分别慢10.41 s和13.56 s,约占本文算法运算速度的4.30%和5.60%。

表 2. 算法性能比较

Table 2. Comparison of performance of different methods

|

本文算法单独测试了分类器算法分步骤的运行速度,其中车载视频样本制作耗时234.19 s,训练耗时3.84 s,测试耗时4.15 s;无人机视频样本制作耗时13.80 s,训练耗时0.53 s,测试耗时0.60 s。可见,在随机蕨分类器的实现过程中,样本制作分别占据总时长的96.70%和92.43%,故可以通过减少初始训练样本数及在线更新分类器参数的方式,提升检测效率,平衡分类性能及在线学习速度这对矛盾。

由于无人机拍摄空间较空旷,行人及背景亮度差别较大,区分更为明显,故该算法在无人机视频中行人检测的应用分类精确度更高。

图 4. 无人机视频误检率变化曲线

Fig. 4. Changing curve of false detection rate of unmanned aerial vehicle video

图 5. 算法识别效果。(a)~(e)车载视频;(f)无人机视频

Fig. 5. Recognition results of proposed algorithm. (a)-(e) Vehicle videos; (f) unmanned aerial vehicle video

5 结论

分析基于移动平台搭载热成像摄像机拍摄的视频,利用随机蕨分类器进行成像区域内的行人检测。热成像图片不同于彩色图片,可利用的色彩信息很少,因此选用亮度特征和OSC-LBP纹理特征作为随机蕨分类器的特征参数,从视频中手动框选行人及背景区域后,通过对框选区域进行拉伸映射等变换,获得初始分类器训练样本;实际检测时将检测到的目标更新到训练样本库中,同时更新随机蕨分类器对应类型的后验概率分布,从而实现了分类器的在线自主学习过程。通过仿真测试证明所提方法的误检率低,算法执行速度及分类速度快,且易于理解和使用,移植方便快捷,适用于对实时性要求较高的应用,具有一定的实际工程意义。根据仿真验证结果,发现通过不断优化特征类型及训练参数将会获得更优的检测数据。该方法为今后的研究提供了一个新的思路,可以为相关领域的研究提供参考。

[1] Kwak JY, KoB, Nam JY. Multi-person tracking based on body parts and online random ferns learning of thermal images[C]. IEEE Winter Conference on Applications of Computer Vision, 2015: 41- 46.

[2] 金晓会, 杨卫, 白晓方. 一种用红外热像仪检测与跟踪遮挡目标的方法[J]. 红外技术, 2014, 36(8): 639-643.

[4] 李思俭, 樊祥, 朱斌, 等. 基于运动模糊复原技术的红外弱小目标检测方法[J]. 光学学报, 2017, 37(6): 0610001.

[13] 李建福. 红外图像中人体目标检测、跟踪及其行为识别研究[D]. 重庆: 重庆大学, 2010: 1- 10.

Li JF. Research on human detection, tracking and action recognition in infrared images[D]. Chongqing: Chongqing University, 2010: 1- 10.

[18] 罗大鹏, 罗琛, 魏龙生, 等. 基于在线随机蕨分类器的实时视觉感知系统[J]. 电子学报, 2016, 44(5): 1139-1148.

[20] Roth PM, GrabnerH, BischofH, et al. Online conservative learning for person detection[C]. 2005 2 nd Joint IEEE International Workshop on Visual Sruveillance and Performance Evaluation of Tracking and Surveillance , 2005: 223- 230.

Article Outline

诸葛琳娜, 张磊. 基于移动平台热成像的行人检测随机蕨分类器[J]. 激光与光电子学进展, 2018, 55(1): 013301. Zhuge Linna, Zhang Lei. Random Ferns Classifier for Pedestrian Detection Based on Thermal Imaging of Mobile Platform[J]. Laser & Optoelectronics Progress, 2018, 55(1): 013301.