融合渐进空间金字塔的YOLOv8芒果目标检测算法研究【增强内容出版】

1 引言

近年来,随着我国芒果种植产业的迅速发展,发展模式也逐步从数量扩展向质量提升转变。但是,针对果实质量的管控与监测还停留在人工排查阶段,这制约了芒果产业的发展。目前,计算机视觉的发展使得果实质量监测成为一项可行的任务,涌现出越来越多的算法。

传统的水果图像识别方法主要是人工根据先验信息设计手工特征,如根据颜色、形状、纹理等特征设计特征检测器,进而使用非监督或监督分类算法进行识别计数,如K-Means聚类算法[1]、基于密度的噪声应用空间聚类(DBSCAN)算法[2]和高斯混合模型(GMM)[3],或者经典的支持向量机和K最近邻等[4-9]。然而,受光照造成的颜色变化,以及距离、遮挡、重叠造成的形状变化的影响,算法计数的鲁棒性下降,这制约了传统水果图像识别算法的发展。但随着深度学习的兴起,研究人员逐步采用分割网络[10-11]或检测网络[12-13]替代传统识别方法。网络模型具有隐含的特征表达能力和较强的泛化能力,提升了检测的鲁棒性。

截至目前,国内外涌现出不少在不同领域应用的神经网络和深度学习方法[14-16]。在水果图像识别检测应用中,Kestur等[17]提出MangoNet,并将其应用于开放果园环境中对芒果进行识别和计数,该方法在复杂背景和遮挡条件下表现出色。Nanaa等[18]提出结合随机霍夫变换和反向传播神经网络的芒果检测方法,有效提高了检测精度。Borgoti等[19]利用真实果园数据集训练网络,提升了遮挡、光照变化和复杂背景下的水果检测准确率。上述方法通常从待识别芒果图像的一个尺度进行分析和处理,而尺度变化带来的计数准确性下降是水果检测面临的一大挑战。因此,本文将YOLOv8目标检测网络[20]与多尺度特征融合模块渐近特征金字塔网络(AFPN)[21]融合,以克服网络尺度特征单一的局限性,并通过数据增强、训练策略的优化,来提升芒果识别计数的准确性与鲁棒性。

2 芒果计数算法

YOLO目标检测网络具有多重优势。首先,在网络结构方面,YOLOv8采用新的Backbone网络、无锚点头部和改进的损失函数,有效改善小目标检测能力,显著提高检测准确率。此外,YOLOv8在检测速度方面有所突破,易于在现实场景中进行部署。综合来看,YOLOv8在网络结构设计、检测精度、检测速度和部署易用性等方面均表现优异,是一种理想的目标检测网络。

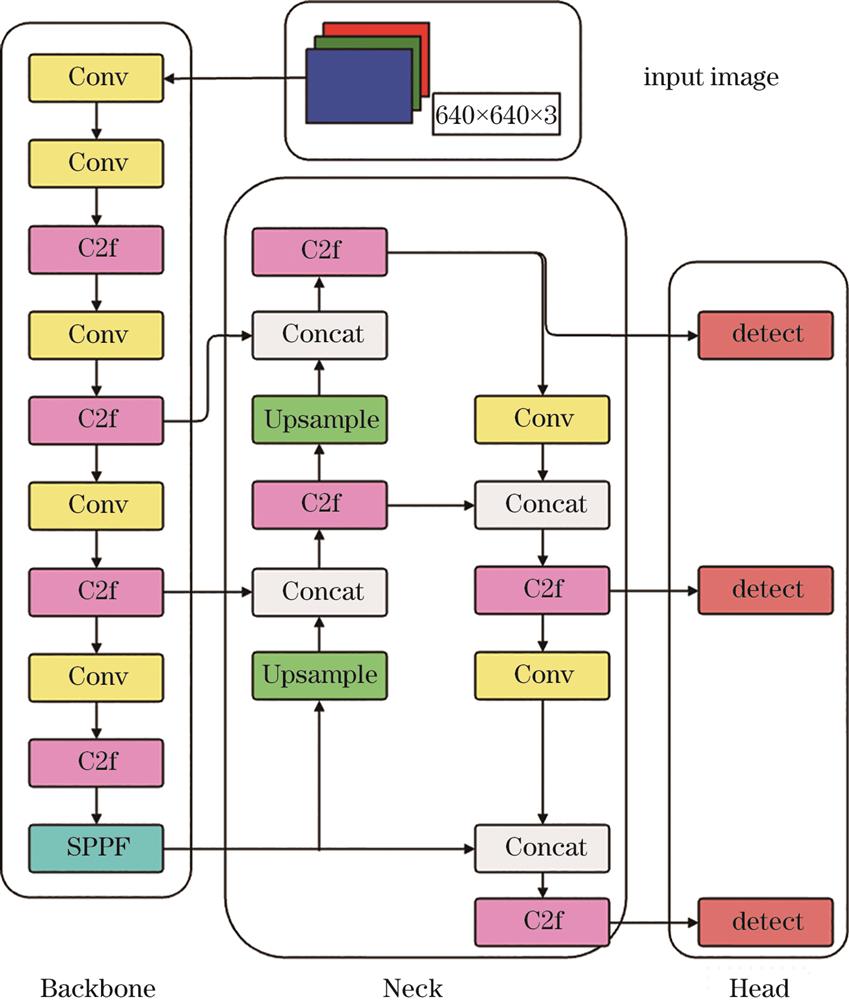

2.1 总体网络

YOLO系列检测网络将目标检测任务转化为回归问题,在单个网络中同时进行目标定位和分类,实现端到端的目标检测。检测过程中图像被划分为S×S个网格,网络预测每个网格边界框和每个边界框的类别概率。每个网格由(x, y, w, h, confidence)5个值定义,其中,(x,y)表示边界框的中心坐标,w、h分别表示边界框的宽、高,confidence表示边界框中存在目标的置信度,即单元格包含目标的概率大小,取值范围为0~1。如果网络单元格内存在目标,则该网络单元格负责检测识别该目标。整个网络通过多层卷积和池化层来提取特征,并通过全连接层输出上述边界框和类别概率。YOLOv8网络的端到端检测原理使得该网络在检测过程中具有更好的适应性和鲁棒性,总体结构包括骨干网络(Backbone)、颈部网络(Neck)、检测头(Head)3个部分,如

2.2 主干网络

C2f模块是YOLOv8网络结构中的主要特征提取单元,旨在优化特征提取、特征增强与多层次特征的融合过程,其结构如

模型的深度参数通过depth_multiple进行控制,可以灵活调整Bottleneck模块的数量,从而有效平衡模型的精度与计算复杂度。通过对Bottleneck块数量的调节,C2f模块可以根据不同的任务需求动态优化网络深度,使其适用于有计算资源限制的场景。此外,拼接后的特征图再经过一个额外的卷积层进行整合处理,进一步提升特征的表达能力,为后续任务提供高质量的特征输入。

2.3 改进的YOLO检测模型

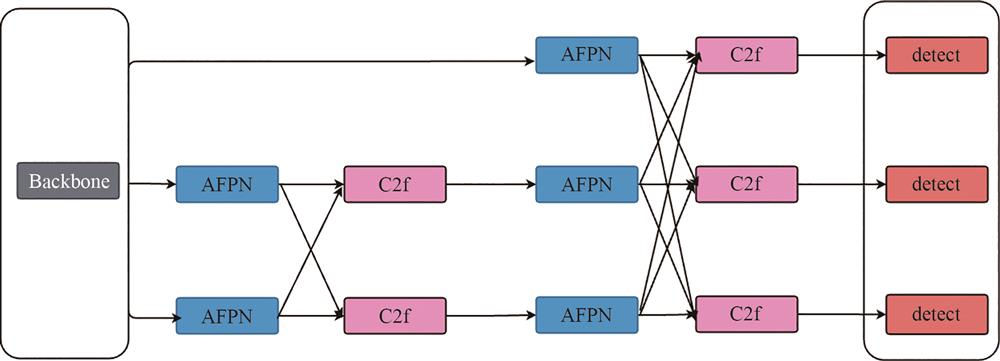

在芒果检测计数实验中,当芒果图像的大小发生变化时,网络的鲁棒性会变差。此外,不同视角、距离导致的图像中芒果尺度变化也会影响检测计数的准确性。为解决这个问题,对YOLOv8网络结构进行改进,引入特征融合模块AFPN来提升不同深度下的特征提取能力,所提网络结构如

AFPN是一种改进的特征金字塔网络,旨在通过多层级设计和自适应特征融合机制来显著提升目标检测性能。AFPN从主干网络(Backbone)提取不同尺度的特征图,通过上采样和下采样与特征图对齐分辨率,利用可学习的权重参数α和β动态加权融合浅层高分辨率特征与深层强语义信息,确保多尺度特征的高效利用。同时,AFPN可集成注意力机制,进一步增强特征表达能力,突出有效信息并抑制冗余特征。此外,AFPN在特征融合过程中能根据不同目标尺度和数据分布自适应地调整各特征图的贡献,确保网络在小目标检测和大目标检测中均表现优异。AFPN可输出多尺度特征金字塔,用于目标分类和边界框回归。通过合理的参数设置,如上采样方式和权重初始化,以及网络结构设计,AFPN不仅增强了对小目标的检测能力,而且平衡了不同尺度特征的表达,显著提升了目标检测的精度与泛化能力,适用于复杂场景下的检测任务。

AFPN模块的优势不仅体现在特征的高效提取和融合上,还在于其在不同网络深度下的适应性。通过多尺度信息的有效利用,AFPN模块为YOLOv8模型在复杂场景中的目标检测提供强有力的支持,使其在应对不同尺度的挑战时表现突出。AFPN的灵活性和高效率使改进YOLOv8模型在保证检测精度的同时,降低计算资源的占用,极大提升其在实际应用中的实用性。

3 实验与分析

为验证所提网络结构的有效性,在公开数据集上进行实验,并与现有的其他方法进行对比分析。此外,在实际采集制作的芒果数据集进行实验,以验证所提网络的准确性与鲁棒性。

3.1 数据集

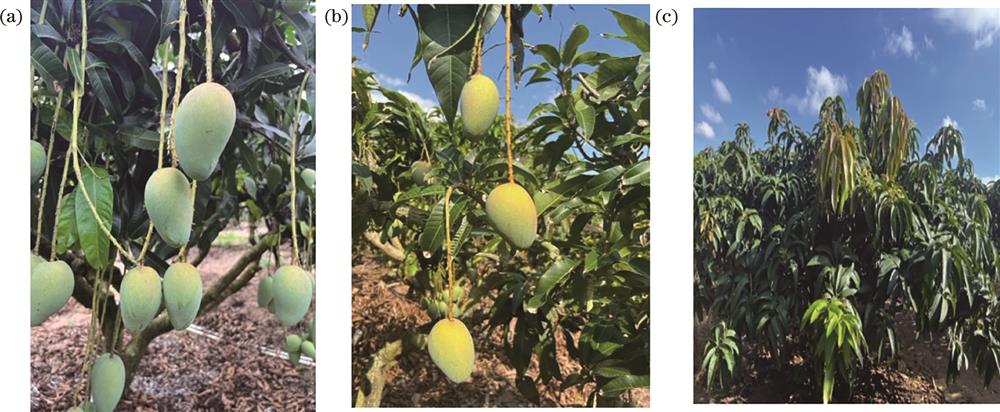

2024年5月,在位于海南省海口市、广西壮族自治区贵港市的芒果园内进行不同品种的芒果图像采集实验,旨在构建1个丰富的芒果图像数据集。自制数据集中部分芒果图像如

图 4. 自制数据集中部分图像。(a)芒果图像1;(b)芒果图像2;(c)背景图像

Fig. 4. Partial images of self-made dataset. (a) Mango image 1; (b) mango image 2; (c) background image

使用图像标注软件LabelImg对图像进行详细标注,共标注24464个芒果。每幅图像的平均芒果数量为8个,单幅图像最多包含25个芒果。将构建的3360幅芒果图像按照70%为训练集、15%为验证集和15%为测试集的比例进行划分,即2352幅用于训练,504幅用于验证,504幅用于测试。不同数量芒果的图像分布有助于提升数据集的质量,从而增强模型的性能。

为更全面地评估所提模型的性能,选用公开数据集MangoSet-A[22]、MangoSet-B[23]和MangoSet-C[24]进行验证。MangoSet-A数据集包含7379幅图像,分辨率为640 pixel×640 pixel,其中,6385幅用于训练,663幅用于验证,331幅用于测试。MangoSet-B数据集包含50幅图像,分辨率为640 pixel × 640 pixel,其中,35幅用于训练,10幅用于验证,5幅用于测试。MangoSet-C数据集包含1129幅图像,分辨率为224 pixel×224 pixel,其中,763幅用于训练,226幅用于验证,140幅用于测试。这些数据集覆盖了不同分辨率和规模的图像,能有效测试模型在各种实际场景中的泛化能力。各数据集的详细信息如

表 1. 不同数据集详细信息

Table 1. Detailed information of different datasets

|

在自制数据集构建过程中,特别考虑了尺度变化对芒果计数的影响,因此采集不同尺度的芒果图像,以增加图像的多样性。此外,将无芒果图像作为背景图像,能有效降低模型在训练过程中可能出现的过拟合问题,提升模型的泛化能力。以上方式确保了构建的自制数据集具有更好的代表性,为芒果检测和计数的实验奠定了良好的基础。

3.2 损失函数

YOLOv8目标检测网络的损失函数综合了边界框回归损失、分类损失和置信度损失,旨在同时优化定位精度和分类精度。边界框回归损失采用完全交并比(CIoU)来衡量预测框与真实框的重叠程度、中心点距离和长宽比差异,确保模型在定位时能更准确地对齐目标。边界框回归损失的计算公式为

式中:

分类损失通常使用二值交叉熵(BCE)或焦点损失来优化类别预测,其中焦点损失通过增加难分类样本的权重来有效应对类别不平衡问题,提升检测效果。分类损失的计算公式为

式中:

置信度损失同样使用BCE损失,评估模型对预测框是否包含目标的信任度,从而减少误检。置信度损失的计算公式为

式中:

式中:

YOLOv8的损失函数通过多任务优化平衡各部分权重,使模型在处理尺度变化、复杂背景和类别不均衡时表现更为稳健,维持了YOLO系列的高效性与精度。

3.3 评价指标

为进一步分析芒果图像识别与计数效果,利用平均计数误差(MAE)、计数准确率(CA)对网络结果进行评价。计算公式如下:

式中:

3.4 网络训练

为增强模型对尺度变化的检测能力,将采集标注的3360幅芒果图像划分为训练集、验证集和测试集,分别包含2352、504、504幅图像。这一划分比例能保证模型在训练阶段有足够的样本进行学习,同时保留足够的验证和测试数据用于评估模型性能,避免过拟合。

针对训练集,首先,通过随机缩放操作来改变图像中芒果的大小,帮助模型学习不同尺度下的芒果特征。其次,通过改变分辨率使网络适应不同大小的输入图像,进一步增强对尺度变化的适应能力。此外,通过随机裁剪来模拟部分遮挡和不同视角下的芒果场景,促使模型在实际应用中更具鲁棒性。最后,改变颜色与亮度,模拟不同光照条件下的图像效果,增强模型在各种光照环境下的适应性。这些数据增强方法能有效扩充训练数据的多样性,使模型在训练时能看到更多的场景变化,进而提升其在实际应用中的鲁棒性和准确性。另外,验证集和测试集不进行数据增强,保持其原始性,以便客观评估模型在未见过的数据上的表现,确保其适应性和稳定性。

3.5 实验结果及分析

3.5.1 与其他方法对比

为进一步验证所提算法的实际效果,在相同的实验条件下,将所提网络与Faster R-CNN[25]、RetinaNet[26]和YOLOv8进行对比。Faster R-CNN实验中,初始学习率设为0.02,优化器为随机梯度下降(SGD),其动量为0.9,权重衰减为0.0001,训练共总迭代90000步,batch size设为16,学习率在60000步和80000步时分别衰减为上一阶段的1/10。RetinaNet实验中,初始学习率设为0.01,优化器同样为SGD,其他参数与Faster R-CNN一致。使用预训练模型YOLOv8时,初始学习率设为0.01,优化器为SGD,动量为0.9,权重衰减为0.0005,训练500个epoch,batch size为16。所提改进网络与YOLOv8网络参数保持一致。上述网络的输入图像分辨率统一为640 pixel×640 pixel。

将上述网络分别在MangoSet-A、MangoSet-B、MangoSet-C和自制数据集上进行对比,结果如

表 2. 不同算法在不同数据集中的CA对比

Table 2. Comparison of CA for different algorithms on different datasets

|

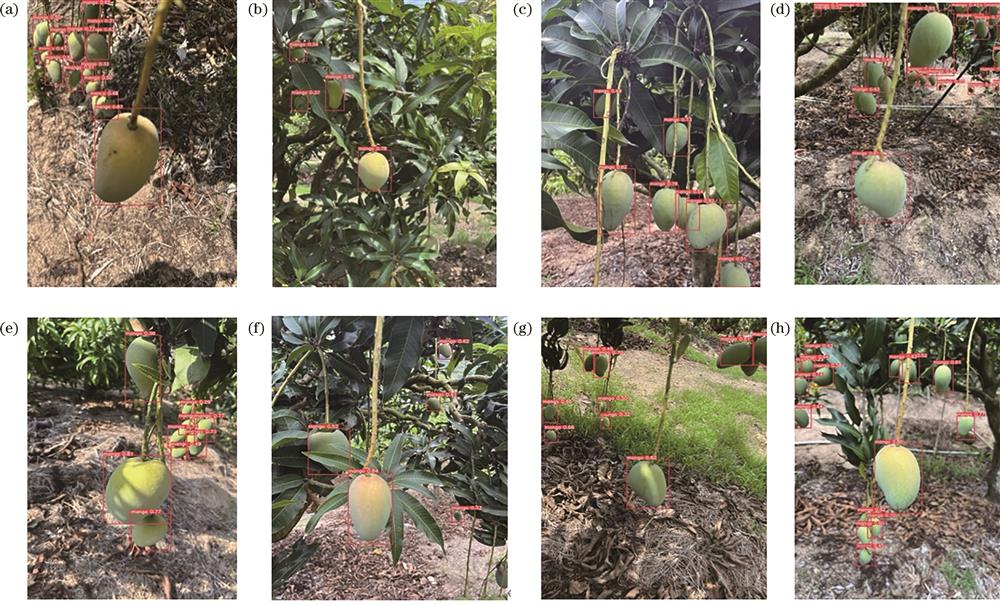

为全面评估改进算法在不同尺度下的检测性能,从实际采集的数据集中随机抽取不同尺度的芒果图像进行实验。实验中为确保样本的均衡性,采用分层抽样方法。首先按照芒果大小将芒果数据集划分为小、中、大3类,然后在每个类别中,以相同的比例随机抽取测试样本。这种分层抽样的方法能够确测试集中不同尺度的芒果都有足够的代表性,避免测试结果因数据分布不均产生偏差。通过这种方式,可以更准确地评估模型检测不同尺度芒果的精度和鲁棒性,从而验证模型的多尺度检测能力。部分图像的检测与识别效果如

由

然而,尽管改进算法在检测精度上具有显著优势,但仍存在一些不足。首先,增加的数据增强策略和更复杂的网络结构提高了训练的复杂性,导致模型训练时间延长。另外,在目标严重遮挡、复杂光照条件下,虽然改进算法在一般场景表现稳定,但依然存在一定的识别误差,这表明模型在应对极端条件时仍需要进一步提升其鲁棒性。未来的工作可以进一步优化模型结构,以减少计算资源的需求,进而满足更广泛的农业应用需求。

总体而言,通过结合AFPN模块有效的多尺度特征学习与训练中采用的数据增强策略,所提算法在芒果计数任务中表现出明显的性能提升。

3.5.2 AFPN模块的影响

为进一步验证AFPN模块的效果,对比YOLOv8与所提改进网络的结果,并在不同分辨率条件下验证所提网络在芒果不同尺度下的计数准确性,结果如

表 3. YOLOv8与所提网络在不同分辨率的CA对比

Table 3. Comparison of CA between YOLOv8 and the proposed network at different resolutions

|

从

综上所述,所提网络引入AFPN后,通过有效融合多尺度特征,显著提高了芒果计数的准确性,在不同分辨率下均能表现出优越性,这验证了所提改进策略在多尺度检测中的优势。

4 结论

本文介绍了以YOLOv8算法为代表的卷积神经网络,针对以芒果为识别对象和受尺度变化等因素影响的芒果计数任务提出了改进方案。具体来说,结合YOLOv8目标检测网络的优势,并引入AFPN渐进空间金字塔结构,可显著增强模型对芒果在不同尺度下的适应性。此外,结合数据增强和优化的训练策略,可有效提升模型的泛化能力。在多个公开芒果数据集上的对比实验表明,改进的YOLOv8+AFPN网络的表现均优于传统网络结构,尤其在不同分辨率和尺度变化的背景下具有显著的检测优势。在真实场景采集的芒果数据测试中,改进算法在整体识别率上明显优于对比模型,且其在实际应用中的可行性得到验证,证明了改进方案的有效性和实用价值。

[4] 廖崴, 郑立华, 李民赞, 等. 基于随机森林算法的自然光照条件下绿色苹果识别[J]. 农业机械学报, 2017, 48(S1): 86-91.

Liao W, Zheng L H, Li M Z, et al. Green apple recognition in natural illumination based on random forest algorithm[J]. Transactions of the Chinese Society for Agricultural Machinery, 2017, 48(S1): 86-91.

[6] 傅隆生, 冯亚利, Elkamil Tola, 等. 基于卷积神经网络的田间多簇猕猴桃图像识别方法[J]. 农业工程学报, 2018, 34(2): 205-211.

Fu L S, Feng Y L, Tola E, et al. Image recognition method of multi-cluster kiwifruit in field based on convolutional neural networks[J]. Transactions of the Chinese Society of Agricultural Engineering, 2018, 34(2): 205-211.

[8] 李国进, 董第永, 陈双. 基于计算机视觉的芒果检测与分级研究[J]. 农机化研究, 2015, 37(10): 13-18.

Li G J, Dong D Y, Chen S. Research on mango detection and classification by computer vision[J]. Journal of Agricultural Mechanization Research, 2015, 37(10): 13-18.

[12] 巩晴, 尚庆生, 郭泓, 等. 芒果图像的改进EfficientNet模型分级[J]. 宜宾学院学报, 2022, 22(12): 1-5.

Gong Q, Shang Q S, Guo H, et al. A study on mango image grading based on an improved EfficientNet model[J]. Journal of Yibin University, 2022, 22(12): 1-5.

[13] 胡艺馨, 张逸杰, 方健, 等. 面向目标检测任务的轻量化网络模型设计[J]. 计算机工程与设计, 2023, 44(2): 548-555.

Hu Y X, Zhang Y J, Fang J, et al. Design of lightweight network model for target detection task[J]. Computer Engineering and Design, 2023, 44(2): 548-555.

[14] 吴磊, 储钰昆, 杨洪刚, 等. 面向铝合金焊缝DR图像缺陷的Sim-YOLOv8目标检测模型[J]. 中国激光, 2024, 51(16): 1602103.

[15] 单慧琳, 王硕洋, 童俊毅, 等. 增强小目标特征的多尺度光学遥感图像目标检测[J]. 光学学报, 2024, 44(6): 0628006.

[16] 陈翼景, 皮一涵, 庞逸轩, 等. 大视场多尺度非接触光声智能缺陷检测算法[J]. 中国激光, 2024, 51(21): 2109002.

[23] Whan. Mango-nok3g[EB/OL]. [2024-10-28]. https://universe.roboflow.com/whan/mango-nok3g.

Article Outline

王宝宇, 李汉棠, 陈希用, 姚伟. 融合渐进空间金字塔的YOLOv8芒果目标检测算法研究[J]. 激光与光电子学进展, 2025, 62(14): 1415002. Baoyu Wang, Hantang Li, Xiyong Chen, Wei Yao. Mango Target-Detection Algorithm Based on YOLOv8 Integrated with Adaptive Spatial Pyramid[J]. Laser & Optoelectronics Progress, 2025, 62(14): 1415002.