基于改进的U-Net网络模型的叶片病害检测【增强内容出版】

1 引言

我国是农业大国,农业种植技术迅速发展,但农作物病虫害造成的减产减质问题依然较为严重。农作物病害严重影响农作物的产量和质量,病发处多为叶部,其中叶部的大斑病和锈病最为常见[1]。及时准确地识别并控制农作物病害可以将危害降到最低,目前常见的方法还是请农业专家实地勘察,基于专业知识和经验对农作物病害情况进行辨识,这种方法不仅主观性较强,而且费时费力、效率不高,严重依赖于人为的识别和判断,不能及时发现病害,造成病害进一步恶化;另一方面由于无法精准、快速、全面地评估作物病虫害发生程度,极容易造成农药化肥的滥用,造成生态环境的破坏。

随着机器视觉、计算机数据处理等前沿技术的不断创新发展,研究人员将机器视觉技术引入农作物病虫害绿色防控技术体系中,在病虫害数据收集、预处理、检测模型研究及评估方面做了大量工作,研究者深入田间进行病害数据采集和收集网络公开数据集,如PlantVillage公开数据集包含14种农作物共26类病害叶片及部分健康农作物叶片;全国农业技术推广服务中心联合公司利用实时拍照记录,建立38种害虫样本库等[2]。数据增强方面主要有数据补充和图像转换两种方法。模型检测识别方面主要集中于病虫害种类识别和检测两个方向。胡嘉沛等人[3]基于YOLOv4-Tiny模型提出一种适用于嵌入式系统的柑橘木虱识别模型,该模型的柑橘木虱平均识别精度为96.16%。杨雨昂等人[4]基于DenseNet提出了西瓜叶片病虫害识别模型,该模型在对真实环境下的西瓜叶片病虫害图片的分类准确率约为86%。刘广等人[5]基于改进YOLOv3提出了一种葡萄叶部病虫害检测方法,模型平均检测精度可达90.4%。

目前基于深度学习技术在农作物病虫害检测领域积累了大量的研究,但是这些研究大都集中在病虫害识别上,对于叶片病害程度的检测尚缺少方法。病害程度检测可以更好地指导生产技术人员做针对性的治疗,在农药使用上做到更精准并减少使用量。本实验针对病害程度检测提出采用特征提取网络ResNet对U-Net的骨干网络进行优化,并在网络不同层之间的特征融合中引入注意力机制,以进一步提升模型的检测精度。整体模型通过对叶片的实例分割获得叶片整体分割图像及病害区域分割图像,最后通过计算病害区分割图像与农作物叶片分割图像的面积之比得出病害情况的估计值。

2 材料与方法

2.1 数据材料

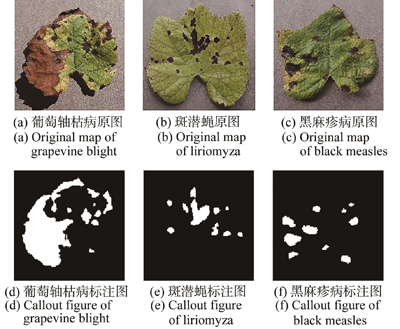

本文的训练数据集采用AI Challenger 2018农作物病害图片分类比赛数据集、植物及其健康咨询平台PlantVillage的植物病害数据集中关于葡萄叶片病害的图片[6]。建立的数据集共包含4类不同程度葡萄叶片病害的图片共9 018张。通过Labellmg图像标注工具对图像进行标注,原图及标注实例如

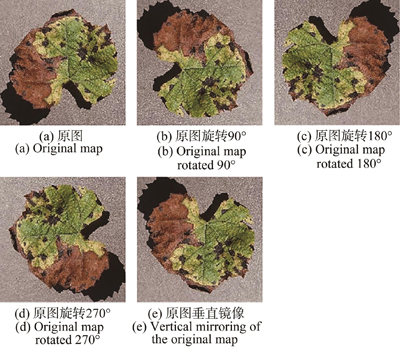

原数据集图片基本是叶片位置一致,但在实际作物叶片的形态上可能是多形态的。出于平衡数据集各叶片形态类型、实际生产中叶片位置的不一致和提升数据多样性的考虑,本文将原始病害数据样本按照1∶1∶1∶2的比例随机划分为4个样本集,分别采取90°旋转、180°旋转、270°旋转、上下镜像调整4种图像增强方法进行处理和扩充原数据集样本,原图片和图片标注处理的效果如

2.2 方法

2.2.1 改进的U-Net模型

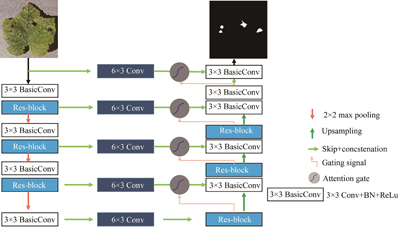

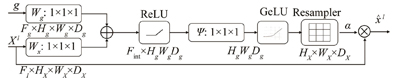

U-Net网络模型因其良好的性能和可以有效地利用GPU内存而被广泛用于图像分割任务。其优势在于可在多个图像尺度上提取图像特征,基于主干网络的上采样和下采样可捕获上下文信息并突出显示前景对象的类别和位置。在多个尺度上提取的特征图随后将通过跳过连接进行合并,以结合全局特征级别和各层特征实现前景对象和细粒度对象的精细化分割。本文将U-Net网络作为叶片病虫害图像分割的基础网络,同时加入残差网络(ResNet)改造U-Net网络的主干网络,在多层特征融合上加入注意力机制提升模型的泛化能力。改进的U-Net网络模型结构如

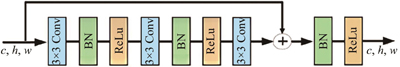

Res-Unet网络集成了ResNet残差模块和U-Net网络,能够有效克服网络层加深造成的过度参数和梯度色散。宋蓓蓓等[7]以Res2Net为主要模块构建RGB-高光谱图像重建方法,实验结果表明,以Res2Net为主要模块构建其骨干网络可以在更加细粒度级别提取局部和全局的图像特征。此外,新的残差学习单元在Res-Unet中易于训练,这不仅提高了模型的训练速度,而且可以使网络在不降低精度的情况下获得更少的参数。ResNet主干网络的结构如

2.2.2 注意力机制

为了捕获足够大的接受域从而获取语义上下文信息,在标准的CNN架构中,特征图网格逐渐被降采样,各层之间的特征图经过跳连叠加往往无法获取特征图中的重点有效信息。不断增加的特征图叠加和降采样层数设计往往无法得到较高的精度,模型的训练参数也倍数增加。为了提高精度,目前的分割框架[8-10]依赖于额外的前对象定位模型,将任务简化为单独的定位和随后的分割步骤。在图像处理方法的研究上,如何将图像的局部特征与全局特征相融合以进一步提升模型的精度是当前改进基础模型的研究热点。姜林奇等[11]以ResNetXt网络为主干网络,通过构建多尺度特征与通道特征融合方法用于脑肿瘤良恶性分类,实验结果表明,该方法提高了对肿瘤区域的关注度,降低对冗余信息的关注度,有效提升了脑肿瘤良恶性分类的准确率。本文将注意力机制引入基础模型中,不需要训练多个模型和大量额外的模型参数。与多阶段CNN的定位模型相比,引入注意力机制可以逐步抑制不相关背景区域的特征响应,而不需要在网络间裁剪感兴趣区域(Region of Interest,ROI)。

将注意力机制引入到改进的Res U-Net体系结构中,以扩大模型的感受野,提升U-Net模型中各层特征图通过跳过连接传递的显著特性,见

网络结构中第一个梯度项使用

在注意力系数的处理中,分别采用GeLU函数对其进行归一化处理。相较于GeLU函数,ReLU 等函数在零点不可微,会在某种程度上影响网络的性能[12]。此外,ReLU 等确定性非线性函数作为神经网络的激活函数时,网络往往需要加入随机正则以提高模型的泛化性能。GeLU函数依赖于输入本身的概率统计量为激活函数提供随机正则性,同时保持输入信息,对注意门(Attention Gate,AG)参数的训练收敛性具有更好的实验结果,其形式如

其中,

其中,

2.2.3 模型训练

本文在Pytorch框架下构建模型,训练和验证环境的软硬件配置如

表 1. 软硬件配置

Table 1. Software and hardware configuration

|

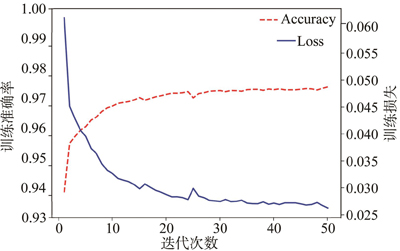

训练过程如

3 结果分析

3.1 不同深度的U- NET模型检测结果分析

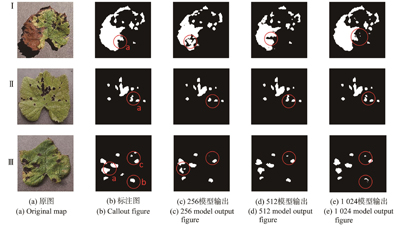

为了对改进的U-Net网络模型的检测性能做进一步的分析,本文设计了不同深度的U-Net网络模型在同一条件下进行了对比实验,即采样最大深度为256、512、1 024三种改进的模型。对比实验结果如

表 2. 不同采样深度的检测性能

Table 2. Detection performance of the models at different sampling depths

|

图 7. 不同采样深度的改进U-Net模型检测效果图

Fig. 7. Detection effect diagram of improved U-Net model at different sampling depths

3.2 模型中间结果分析

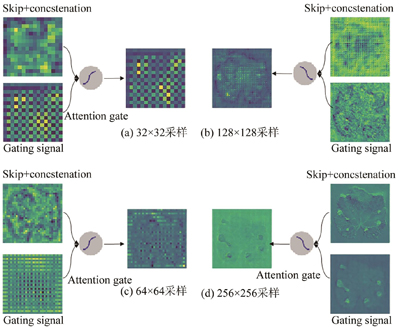

为了进一步表征模型检测性能和透视注意力机制在模型特征融合的作用,将跳过连接层(Skip+Concstenation)、门信号层(Gating Signal)和经过注意力机制(Attention Gate)处理之后的特征图抽取出来进行分析,如

4 结论

本文设计了一种改进的U-Net网络模型用于叶片病虫害严重程度估计,通过不同最大采样深度的对比实验以及通过抽取并分析模型各层不同采样深度下的中间特征图,验证了改进的U-Net网络模型的性能。首先,在主干网络上选取ResNet50网络,并在训练上借助预训练模型ResNet50对主干网络的参数进行初始化,提升了网络模型的训练收敛速度,降低了计算成本。其次,引入了一种注意力机制对U-Net网络的各层特征提取及融合进行优化,以进一步提升网络模型接收关键信息的能力。通过分析模型不同采样深度下的各层特征图可以得出,注意力机制的引入使网络模型可以获取叶片整体特征以及病害区域的特征两个维度的信息,并对这两个维度信息进行较好的融合。

从对比分析实验的结果可以看出,改进的U-Net512网络模型具有最优的检测性能,平均检测精度达到90.14%,平均绝对误差达到276.3。本文设计的改进U-Net模型在评估作物病虫害发生程度上具有较好的效果,可用于智慧农业领域的病害检测设备。在实际的病虫害防治过程中,农业从业人员可以基于模型评估的作物病虫害发生程度信息来精准调控农药、化肥等的使用,一方面能尽早发现病虫害情况,降低农业损失;另一方面由于精准施药降低了农药化肥的使用,保障了农产品的质量。但本文工作都是针对实验室环境下叶片相对平整的情形,尚未经过在智慧农机装备上的经验验证,后续工作将把训练好的网络模型部署在病虫害检测设备上,通过采集现实作物病害数据进行进一步的训练,获取在实际环境中可用的网络模型,同时测试其在实际工作环境下的检测效果。

[1] 兰志斌. 农作物病虫害监测与防控技术研究[J]. 园艺与种苗, 2022, 42(12): 92-94.

LAN Z B. Study on monitoring and control technology of crop diseases and insect pests[J]. Horticulture & Seed, 2022, 42(12): 92-94.

[2] 宋仕月, 陈政羽, 郑一凡, 等. 深度学习在农业病虫害智能识别方面的研究进展[J]. 智慧农业导刊, 2023, 3(4): 1-4.

SONG S Y, CHEN Z Y, ZHENG Y F, et al. Research progress of deep learning in intelligent identification of agricultural diseases and insect pests[J]. Journal of Smart Agriculture, 2023, 3(4): 1-4.

[3] 胡嘉沛, 李震, 黄河清, 等. 采用改进YOLOv4-Tiny模型的柑橘木虱识别[J]. 农业工程学报, 2021, 37(17): 197-203.

HU J P, LI Z, HUANG H Q, et al. Citrus psyllid detection based on improved YOLOv4-Tiny model[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2021, 37(17): 197-203.

[4] 杨雨昂, 闫星辰, 肖潇, 等. 基于DenseNet的西瓜叶片病虫害识别模型[J]. 电脑与信息技术, 2023, 31(2): 19-23.

YANG Y A, YAN X C, XIAO X, et al. A recognition model of watermelon leaf disease base on DenseNet[J]. Computer and Information Technology, 2023, 31(2): 19-23.

[5] 刘广, 胡国玉, 古丽巴哈尔·托乎提, 等. 基于改进YOLOv3的葡萄叶部病虫害检测方法[J]. 微电子学与计算机, 2023, 40(2): 110-119.

LIU G, HU G Y, TUOHUTI G, et al. Detection of grape leaf diseases and insect pests based on improved YOLOv3[J]. Microelectronics & Computer, 2023, 40(2): 110-119.

[6] HUGHESD P, SALATH’EM. An open access repository of images on plant health to enable the development of mobile disease diagnostics [J/OL]. arxiv, 2015:1511.08060.

[7] 宋蓓蓓, 马穗娜, 何帆, 等. Res2-Unet深度学习网络的RGB-高光谱图像重建[J]. 光学 精密工程, 2022, 30(13): 1606-1619.

[11] 姜林奇, 宁春玉, 余海涛. 基于多尺度特征与通道特征融合的脑肿瘤良恶性分类模型[J]. 中国光学(中英文), 2022, 15(6): 1339-1349.

Article Outline

刘林, 林山驰, 李相国, 冯敏, 许亮. 基于改进的U-Net网络模型的叶片病害检测[J]. 液晶与显示, 2024, 39(8): 1138. Lin LIU, Shanchi LIN, Xiangguo LI, Min FENG, Liang XU. Leaf disease detection based on improved U-Net network model[J]. Chinese Journal of Liquid Crystals and Displays, 2024, 39(8): 1138.