基于双通道GAN的高光谱图像分类算法  下载: 1991次

下载: 1991次

高光谱图像分类问题是高光谱遥感图像处理问题中的研究基础,它的主要目的是根据高光谱遥感图像中的光谱信息和空间信息将图像中的每个像元划分为不同的地物类别[

1 引言

高光谱图像分类问题是高光谱遥感图像处理问题中的研究基础,它的主要目的是根据高光谱遥感图像中的光谱信息和空间信息将图像中的每个像元划分为不同的地物类别[1]。高光谱图像分类技术被广泛应用于环境监测、矿产勘探、**目标识别等领域,然而高光谱图像的高维特性、波段间的高度相关性、光谱混合等使得高光谱图像分类面临着巨大的挑战。因此,高光谱图像分类问题越来越受到学者们的广泛关注[2-4]。

近年来,深度学习在图像处理方面表现出的优势,让高光谱图像分类的研究学者们受到了启发[5-9]。深度神经网络(DNN)的研究取得了重大进展,深度神经网络在图像、视频、语音、文本等领域都表现出优异的特征提取能力,目前已经成为计算机视觉、人工智能和机器学习等领域中最为热门的研究方向之一。尽管使用基于深度神经网络的方法在高光谱图像分类中取得了很大进展,但深度神经网络模型需要大量的训练样本来学习网络参数,而高光谱图像分类数据集训练样本有限,因此网络通常会面临过拟合的问题,这意味着网络在训练阶段表现很好,但是在测试阶段的效果很差[10]。2014年,Goodfellow教授等[11]提出了生成对抗网络(GAN),该网络可以在很大程度上缓解过拟合的现象,并在小样本训练中获得了很好的效果。2018年,Zhan等[12]首次使用GAN来提取高光谱图像的光谱特征,在小样本数据训练问题中,该方法与深度神经网络相比获得了更好的分类效果,但是该方法的框架是固定的,应用于不同数据集时需要调整框架;此外,该方法没有考虑像元之间的空间相关性,分类精度仍有待提高。同年,Zhu等[13]将深度卷积生成式对抗网络[14] (DCGAN)引入到高光谱图像分类中,并提出了基于光谱特征的一维生成式对抗网络(1D-GAN)和基于空谱联合特征的三维生成式对抗网络(3D-GAN)分类框架,得到了很好的分类效果,但是该方法由于生成器不能有效地模拟高维数据,所以在提取光谱特征和空谱联合特征时需要大幅度降维处理,这将损失较多的光谱特征和空谱联合特征。

为此,本文提出一种基于双通道GAN的高光谱图像分类算法。提出改进的一维GAN分类框架,用以提取全部光谱特征,提出改进的二维GAN分类框架,用以提取空间特征;然后结合上述两种框架提出双通道GAN分类框架,采用该框架对光谱特征和空间特征进行融合得到更为全面的空谱联合特征,将该联合特征送入到分类器中进行分类,以提升高光谱图像的分类精度。

2 理论基础知识

2.1 GAN

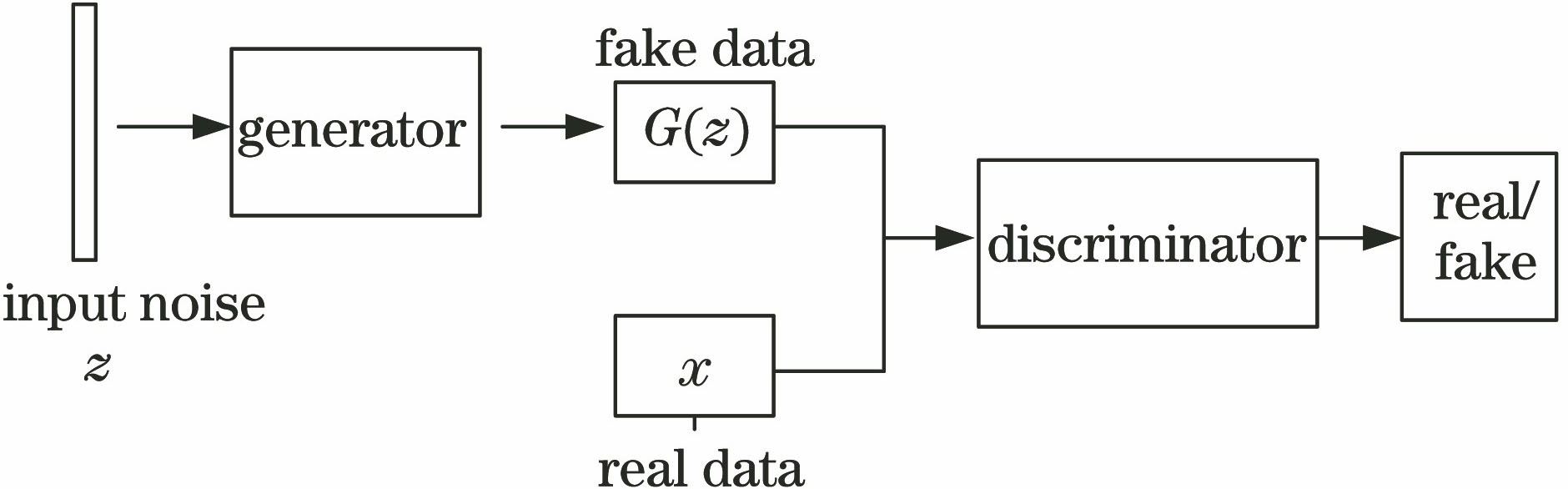

GAN是一种训练生成模型的新方法,也是训练分类器的有效方法。一般情况下,GAN分为两部分:生成器G和判别器D。生成器G用于捕获真实样本的潜在分布进而生成新的数据;判别器D本质上是一个二分类器,用来判别输入的样本是真实的还是虚假的。GAN中的信息传递是从产生假样本的生成器G到判别器D的前馈通道,其目的是为了评估生成器G的输出。GAN的框架结构如

为了通过真实样本

式中

2.2 DCGAN

DCGAN是对GAN结构的改进模型,它在GAN中引入了CNN的网络拓扑结构,并设置了一系列的限制使其可以进行稳定的训练,因此在很多情况下具备更好的稳定性[15]。

DCGAN在原始GAN上做了以下几点改进:其一,在DCGAN中,将原始GAN所有的池化操作用卷积操作来代替,其中判别器D中的池化层用卷积层来代替,而生成器G中的池化层则用反卷积层来替代,这使得生成器G能够学习它自己的空间上采样,而判别器D可以学习它自己的空间下采样;其二,DCGAN在除了生成器G的输出层和判别器D的输入层外的其他层使用批量标准化操作(BN)来稳定学习,有助于处理初始化不良导致的训练结果差的问题;其三,移除了更深层架构的全连接隐藏层,提升了收敛速度;其四,在生成器G的所有反卷积层上使用ReLU激活函数,只有输出层使用Tanh激活函数;其五,在判别器D的所有卷积层上使用LeakyReLU激活函数。

3 基于双通道GAN的高光谱图像分类算法的设计

3.1 高光谱图像GAN分类模型

高光谱图像GAN分类模型[13]利用了DCGAN的框架,并借鉴了条件标签生成式对抗网络[16](ACGAN)的思想,引入了ACGAN中的softmax分类器和目标函数,并将其目标函数加以修改来生成适合高光谱图像分类的目标函数。softmax分类器在多分类中表现出很好的性能,其表达式为

式中:

高光谱图像GAN分类模型考虑了真实数据样本的似然概率和正确标签的似然概率,其框架如

在高光谱图像GAN分类模型的训练过程中,将噪声

将真实训练数据样本和由G生成的假数据样本作为判别器D的输入。真实数据样本的概率分布

式中:

在高光谱图像GAN分类框架中,本文的目的是优化判别器D使

文献[ 13]中提出的高光谱图像GAN分类模型取得了很好分类的结果,但是由于该方法不能有效地模拟高维数据,所以在提取光谱特征和空谱联合特征时需要降维处理,这将损失较多的光谱特征。为此,本文基于上述方法的思想,通过不断实验,一共设计了三个适用于高光谱图像分类问题的框架,即单独提取全部光谱特征的改进一维GAN分类框架、单独提取空间特征的改进二维GAN分类框架和结合上述两个框架提取空谱联合特征的双通道GAN分类框架。

3.2 改进的一维GAN分类框架设计

改进的一维GAN分类框架借鉴了1D-GAN[13]的结构,在此基础上不断实验,更改了网络结构和参数,搭建了新的网络模型框架,以提取高光谱图像全部的光谱特征。该算法不需要对高光谱数据进行降维预处理,也无需随着高光谱图像数据维度的变化而改变网络结构,可以直接将高光谱图像数据送入到网络中,提取全部的光谱特征。由于高光谱图像数据的维度有几百维,信息高度冗余,生成器G可能难以模拟真实数据,为了使生成器G训练稳定且生成的数据能够更加贴近真实样本,本文使用了DCGAN的结构形式,在判别器D中应用了卷积层,在生成器G中应用了反卷积层,并加深了生成器G和判别器D的网络。

改进的一维GAN分类算法的框架和结构如

表 1. 改进的一维GAN分类框架

Table 1. Improved one-dimensional GAN classification framework

|

3.3 改进的二维GAN分类框架设计

改进的二维GAN分类框架在DCGAN框架的基础上重新进行了搭建,使其能够适用于高光谱图像分类问题,以便更好地提取高光谱图像的空间特征,进而提升高光谱图像分类的精度。本文使用主成分分析(PCA)将高光谱图像降维成三维来提取高光谱图像的空间特征。

采用改进的二维GAN分类算法设计的框架和结构如

表 2. 改进的二维GAN分类框架

Table 2. Improved two-dimensional GAN classification framework

|

3.4 双通道GAN分类框架设计

高光谱图像不仅包含光谱特征也包含空间特征,基于空谱联合特征的分类方法往往比基于单特征的分类方法更为有效[4]。因此,为了提取更为全面的光谱特征和空间特征,本文以上述两种模型框架为基础,引入空谱联合特征的思想,设计了如

4 实验仿真与分析

实验仿真采用的是常用于高光谱图像分类的两组数据集,Salinas和Indian pines数据集,这两组数据集都是公开的高光谱基准数据,且包含相对准确的地物覆盖真值,它们的空间和光谱分辨率不同,可以更加全面验证算法的有效性和稳定性,所有数据集将在后续章节中进行详细介绍。为了验证所提算法的有效性和先进性,对比算法采用的是高光谱图像分类算法中的深度卷积分类算法1D-CNN[13]、2D-CNN[13]、3D-CNN[6]和目前效果最好的高光谱GAN分类算法1D-GAN[13]和3D-GAN[13]。改进的一维GAN分类框架(以下简称为HS-1D-GAN)的batchsize设置为100,生成器G和判别器D的迭代次数为1000,学习率设置为0.0002。改进的二维GAN分类框架(以下简称HS-2D-GAN)的batchsize设置为50,生成器G和判别器D迭代次数设置为1000,学习率为0.0002。双通道GAN分类框架(以下简称为HS-TC-GAN)的batchsize设置为50,生成器G和判别器D迭代次数设置为1000,后接softmax分类器的迭代次数为200,学习率设置为0.0002。为了公平对比并验证所提算法在小样本量数据集上的有效性,在所有算法实验过程中,对每一个数据集都选取500个样本作为训练集,数据集中的其余样本作为测试集。其他对比算法中的参数都参照相应文献中给出的参数进行实验。在实验中,将测试所有本文提出算法的精度和性能。所有算法均独立运行20次,最终结果是20次实验结果的平均值。

本文采用常用于评价高光谱图像分类结果的三个精度评价指标来评估所提算法的性能,它们分别是总分类精度(OA)、平均分类精度(AA)和Kappa统计量[17]。

混淆矩阵

总分类精度表示全部测试数据集中被正确分类的样本个数与全部测试集中样本个数之比,其表达式为

式中:OA表示总分类精度;

平均分类精度表示每一个类别分类精度的平均值,其表达式为

式中:AA表示平均分类精度; OA(

Kappa系数表示的是一个预测的分类结果与真实结果吻合程度的指标,它在考虑样本被正确分类的同时,也考虑了各种漏分(某些样本没有被分到应属于的类别中)和错分(某类样本被错误地分到其他类别中)的情况,其计算式为

式中

本文所有实验的硬件平台采用Inter(R)Core(TM)i7-8700k CPU,3.70 GHz,内存32 GB,GPU为GeForce GTX 1080Ti,软件平台采用python 3.6.6和pytorch 0.4.0。

4.1 Salinas数据集仿真实验

Salinas数据集是1998年由AVIRIS从美国加州萨利纳斯山谷采集得到的,该数据波段为0.4~2.5 μm,原始数据包含了224个波段,其空间分辨率为3.7 m,每个波段的图像大小为 512 pixel×217 pixel,去除第108~第112、第154~第167和第224个水吸收波段后,剩余204个可用的光谱波段。

图 7. Salinas数据集。(a) 伪彩色合成图;(b) 地物参考图

Fig. 7. Salinas dataset. (a) Pseudo color composite map; (b) feature reference map

表 3. Salinas dataset sample table

Table 3.

| ||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

表 3. Salinas dataset sample table

Table 3.

| ||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

在Salinas数据集实验中,将算法的训练时间、测试时间和总时间作对比,在比较基于GAN的分类算法和基于CNN的分类算法时,由于GAN需要生成器G和判别器D两个网络一起训练,网络相较CNN复杂,所需参数量更多,所以在基于深度学习的算法中,CNN的训练时间较短。在基于GAN的各类算法中,由于卷积核的选取,网络层数搭建的深度及分别提取光谱特征、空间特征和空谱联合特征所需计算量不同等因素,各类GAN的训练时间也有所不同,其中HS-TC-GAN算法由于有两个通道,相当于两个GAN网络框架,且需要提取空谱联合特征,因此,其训练时间最长,在基于深度学习的算法中测试时间也最长;而1D-CNN算法的网络结构最为简单,仅需对光谱特征进行处理,所以在基于深度学习的分类算法中训练时间最短,在所有算法中测试时间最短。

图 8. Salinas数据集上8种算法的分类结果。(a) 真实地物参考图; (b) 1D-CNN; (c) 1D-GAN; (d) HS-1D-GAN; (e) 2D-CNN; (f) HS-2D-GAN; (g) 3D-CNN; (h) 3D-GAN; (i) HS-TC-GAN

Fig. 8. Classification results of the eight algorithms on the Salinas dataset. (a) Real feature reference map; (b) 1D-CNN; (c) 1D-GAN; (d) HS-1D-GAN; (e) 2D-CNN; (f) HS-2D-GAN; (g) 3D-CNN; (h) 3D-GAN; (i) HS-TC-GAN

4.2 Indian pines数据集仿真实验

Indian pines数据集由AVIRIS于1992年采集于美国印第安州西北部普渡大学农场,该数据集波段为0.4~2.5 μm,其原始数据包含了220个通道,空间分辨率为20 m,图像大小为145 pixel×145 pixel。去除第104~第108,第150~第163及第220个水吸收波段后,剩余200个可用波段。

图 9. Indian pines数据集。(a) 伪彩色合成图;(b) 地物参考图

Fig. 9. Indian pines dataset.(a) Pseudo color composite map; (b) feature reference map

表 5. Indian pines dataset sample table

Table 5.

| ||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

表 4. 8种算法在Salinas数据集上的分类性能比较

Table 4. Comparison of classification performances of eight algorithms on Salinas dataset

|

图 10. Indian pines数据集上8种算法的分类结果。(a) 真实地物参考图; (b) 1D-CNN; (c) 1D-GAN; (d) HS-1D-GAN; (e) 2D-CNN; (f) HS-2D-GAN; (g) 3D-CNN; (h) 3D-GAN; (i) HS-TC-GAN

Fig. 10. Classification results of the eight algorithms on the Indian pines dataset. (a) Real feature reference map; (b) 1D-CNN; (c) 1D-GAN; (d) HS-1D-GAN; (e) 2D-CNN; (f) HS-2D-GAN; (g) 3D-CNN; (h) 3D-GAN; (i) HS-TC-GAN

5 结论

针对现有高光谱图像GAN分类算法提取光谱特征和空谱联合特征不全面而导致的分类精度不高的问题,提出了基于双通道GAN的高光谱图像分类算法。首先,提出了改进的一维GAN分类框架和改进的二维GAN分类框架,并采用这两个框架分别提取高光谱图像全部的光谱特征和空间特征;其次,结合上述两种框架搭建双通道GAN分类框架,采用该框架将得到的光谱特征和空间特征进行融合,并利用得到的空谱联合特征进行高光谱图像分类。实验结果表明,与其他算法相比,本文算法获得了最高的分类精度,证明了本文算法对小样本训练有效的同时,也说明了本文算法对光谱特征和空谱联合特征的提取较现有的高光谱图像GAN分类算法更为全面,高光谱图像的分类精度大幅度提升,验证了本文算法的先进性和有效性。

[1] 崔颖, 徐凯, 陆忠军, 等. 主动学习策略融合算法在高光谱图像分类中的应用[J]. 通信学报, 2018, 39(4): 2018067.

[2] 董安国, 李佳逊, 张蓓, 等. 基于谱聚类和稀疏表示的高光谱图像分类算法[J]. 光学学报, 2017, 37(8): 0828005.

[3] 侯榜焕, 姚敏立, 王榕, 等. 面向高光谱图像分类的空谱半监督局部判别分析[J]. 光学学报, 2017, 37(7): 0728002.

[4] 于纯妍, 赵猛, 宋梅萍, 等. 基于目标约束与谱空迭代的高光谱图像分类方法[J]. 光学学报, 2018, 38(6): 0628003.

[7] Wu H, Prasad S. Convolutional recurrent neural networks for hyperspectral data classification[J]. Remote Sensing, 2017, 9(3): 298.

[10] 张号逵, 李映, 姜晔楠. 深度学习在高光谱图像分类领域的研究现状与展望[J]. 自动化学报, 2018, 44(6): 961-977.

[11] Goodfellow IJ, Pouget-AbadieJ, MirzaM, et al.Generative adversarial nets[C]∥Proceedings of the 27th International Conference on Neural Information Processing Systems, December 8-13, 2014, Montreal, Canada. Cambridge, MA,USA: MIT Press, 2014, 2: 2672- 2680.

[14] RadfordA, MetzL, Chintala S. Unsupervised representation learning with deep convolutional generative adversarial networks[J/OL]. ( 2016-01-07)[2019-02-10]. https: ∥arxiv.org/abs/1511. 06434.

[15] 杨韶晟. 基于VAE的条件生成式对抗网络模型研究[D]. 长春: 吉林大学, 2018: 26- 29.

Yang SS. Research on conditional generative adversarial networks model based on VAE[D]. Changchun: Jilin University, 2018: 26- 29.

[16] OdenaA, OlahC, ShlensJ. Conditional image synthesis with auxiliary classifier GANs[C]∥Proceedings of the 34th International Conference on Machine Learning, August 6-11, 2017, Sydney, Australis. Massachusetts: JMLR. org, 2017: 2642- 2651.

[17] 马晓瑞. 基于深度学习的高光谱影像分类方法研究[D]. 大连: 大连理工大学, 2017: 30- 31.

Ma XR. Hyperspectral imagery classification based on deep learning[D]. Dalian: Dalian University of Technology, 2017: 30- 31.

Article Outline

毕晓君, 周泽宇. 基于双通道GAN的高光谱图像分类算法[J]. 光学学报, 2019, 39(10): 1028002. Xiaojun Bi, Zeyu Zhou. Hyperspectral Image Classification Algorithm Based on Two-Channel Generative Adversarial Network[J]. Acta Optica Sinica, 2019, 39(10): 1028002.