基于视频的掌纹掌脉联合识别系统  下载: 1106次

下载: 1106次

1 引言

随着网络信息技术的不断发展,传统的身份识别方式已经不能满足人们对易用性和安全性的需求,因此一类新的身份识别技术——生物特征识别技术开始得到广泛关注和应用。手部生物特征采集较方便、设备成本低且用户接受度较高,因此基于手部生物特征识别的研究得到了广泛关注,如指静脉识别 [ 1 ] 、指横纹识别 [ 2 ] 、指形识别 [ 3 - 5 ] 、掌纹识别 [ 6 - 8 ] 、掌静脉识别 [ 9 ] 、手背静脉识别 [ 10 ] 和手臂静脉识别 [ 11 ] 等。研究发现,单生物特征识别的信息和表征能力有限,因此单一特征的安全性和识别性能在某些场合并不能满足要求。不少学者尝试将不同的生物特征进行融合,以增加伪造的难度和复杂性,从而提高系统的安全性,如掌纹掌脉的融合 [ 12 ] 和手形与掌纹的融合 [ 13 ] 等。

目前手部生物识别主要针对单张图像进行分析和处理,这在很大程度上限制了所能获取的生物特征数量。视频图像序列中包含了丰富的信息源,更有利于特征的提取。近些年有研究开始采用视频数据进行生物特征的提取和匹配,如基于视频的指纹识别 [ 14 ] 和基于视频的签名识别 [ 15 ] 。这些研究表明,基于视频的识别方法能充分利用采集和认证期间的各种信息,从而有效提升系统的性能。

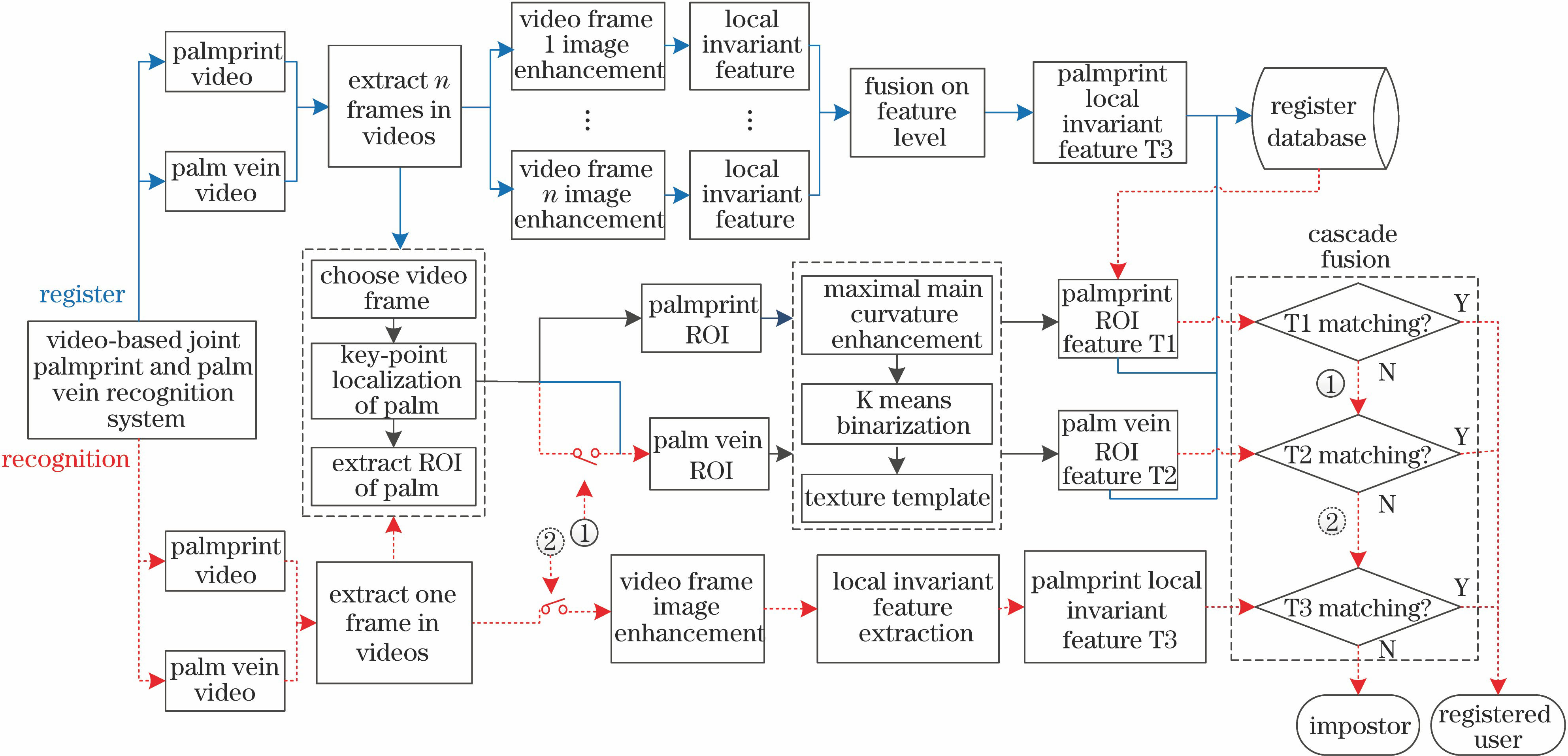

本文提出了一种基于视频的掌纹掌脉联合识别系统,以采集手掌运动视频的方式代替传统的单一图像采集模式,并采用将旋转视频和横扫视频进行融合注册的方式来增强注册模板中特征的丰富性和稳定性,最后结合实际应用引入了一种新的级联融合匹配方式来提高识别速度。

2 掌纹掌脉识别系统简介

所提掌纹掌脉联合识别系统的工作流程如

识别系统的硬件采集系统如

图 2. 识别系统硬件模型。(a)整体外观;(b)内部结构示意图

Fig. 2. Hardware model of recognition system. (a) Overall appearance; (b) diagram of internal structure

3 视频帧筛选

因系统的输入是手掌的一段运动视频,所以首先需要从视频中挑选出有效的目标帧。此外,由于系统采用的相机为双通道摄像头,其可见光通道和近红外光通道的采集是同步的,而且相对于掌纹图像而言,近红外成像的掌脉图像中前景与背景的可区分性更强,因此先基于掌脉视频获取目标帧的序列号,再根据掌脉目标帧序列号获取掌纹视频中的对应帧。

在注册阶段,用户的手掌需水平摆放在采集平台的正上方,并以掌心为中心,按某一角度顺时针进行类似俯仰和翻滚的旋转运动,即手掌以一定角度依次从前往后、从左往右倾斜,采集开始一段时间内(设置为5 s)的手掌旋转视频。将通过上述方式采集的注册视频中的第1帧图像作为基准图像,令其为现有掌纹识别系统所要求的标准手掌摆放姿态。在此基础上,选取另外4帧图像作为辅助图像,从中提取特征以增加掌纹局部不变特征的完备性和稳定性。一般来说,对于4帧辅助图像,在选择时应尽量保证它们之间的姿态存在较大的差异,但在实际应用中考虑到时间消耗的因素,结合视频中手掌运动一般是匀速运动这一先验条件,首先将第1帧之外的所有视频帧平分为4部分,在这4部分视频中分别随机抽取一帧作为辅助图像,即第2~5帧图像。

在识别阶段,用户通过在系统上将手掌横扫而过以完成识别。由于采集的横扫视频帧中手掌前景与背景的可区分性非常强,因此可采用最大连通域的方法确定该帧图像中是否有手掌出现。在系统实际使用过程中,用户手掌的正常横扫速度足以确保横扫视频中有连续多帧图像,且这些图像包含完整的手掌,因此从中任意挑选出一帧图像即可,具体筛选过程如

4 掌部纹理模板提取及匹配

由于所提系统同步采集掌纹和掌脉图像,因此二者手部区域的位置是重合的。考虑到实际采集的掌脉图像背景单一且前景与背景的对比度较高,首先在掌脉图像上进行ROI提取操作,然后截取对应掌纹图像中的掌纹ROI。

图 5. 掌部纹理模板提取步骤。 (a)获取的掌脉图像;(b)掌脉ROI;(c)归一化掌脉ROI;(d)增强图像;(e)二值图像

Fig. 5. Extraction steps of palm texture template. (a) Obtained palm vein image; (b) ROI of palm vein; (c) normalized ROI of palm vein; (d) enhanced image; (e) binary image

针对掌脉匹配,文献[ 16 ]提出了一种基于共同前景的局部二值模式(MF_LBP)的掌脉匹配方法,即首先根据模板匹配结果得到两幅图像的共同前景部分,再对二者的共同前景部分进行局部二进制模式匹配 [ 18 ] ,最后利用模板匹配结果和共同前景局部二值模式(LBP)匹配分数进行支持向量机(SVM)融合,以实现掌脉识别。研究发现,在ROI稳定的情况下,模板匹配和MF_LBP为匹配效果较佳的算法,因此可结合实际应用需求对二者进行决策层的级联融合。

5 掌纹局部不变特征提取及匹配

相比于掌脉图像,掌纹图像拥有更加丰富的纹路信息,且其纹理与背景间具有更剧烈的灰度变化。结合采集的掌纹图像特点,设计了一种新的掌纹特征检测和描述算法。此外,为了充分利用视频中多帧图像所包含的掌纹信息,对从多帧图像中提取到的特征进行有效融合,以改善识别效果。

5.1 带网格约束的特征检测

在处理掌纹图像的过程中,若直接采用经典的特征点检测算法对原始图像进行检测,则提取到的特征点数相对较少;若对增强后的图像进行特征点检测,则会引入噪声,降低特征点的稳定性,使得不同时刻得到的同一手掌检测特征点差异较大。

为克服这个问题,抛弃了传统的特征点检测的步骤,针对性地引入一种新的带网格约束的特征检测方法,该方法通过在归一化的掌纹ROI区域上划分网格,将固定网格分布上的像素点直接作为检测到的特征点。采用固定网格提取特征点的方法得到ROI稳定情况下特征点的重复率较强。此外,即使 ROI纹理部分存在轻微的偏移,网格分布下的相邻特征点也能成功地匹配,具有较强的稳健性。

图 6. 特征点检测的过程。 (a)掌纹ROI;(b)固定网格分布示意图;(c)特征点的检测结果

Fig. 6. Process of feature point detection. (a) ROI of palm print; (b) distribution schematic of fixed grids; (c) detected result of feature points

传统的特征点检测往往涉及大量的尺度估计及区域计算,其计算复杂度较高,而带网格约束的特征检测方法可以有效地提高计算速度,并大幅提升特征点的检测速度。与此同时,在固定网格划分下的特征点,其位置关系较为固定,可用于特征匹配后的去误匹配操作,从而有效提高系统的识别准确率。

5.2 特征描述

为了提高易用性和友好性,新系统不会过多得约束用户的注册姿态,因此注册和识别时用户手掌摆放姿态及运动速度都相对比较随意,使得采集到的视频图像都有一定程度的模糊和旋转。本课题组在前期工作中提出局部不变特征(FRDOH)描述子 [ 19 ] 对掌纹识别具有一定的有效性,因此在系统中采用FRDOH描述子对检测到的掌纹特征点进行描述。同时考虑到尺度不变特征变换(SIFT)描述子能够应对具有尺度、旋转和视角变换的场景,为了验证FRDOH描述子的有效性,将FRDOH与经典的SIFT描述子 [ 20 ] 进行了对比。

5.3 特征融合

如前所述,为了充分利用掌纹视频中的多帧图像信息,采用文献[

21

]中提出的特征融合算法对前述步骤提取的掌纹图像特征进行融合。其中,对掌纹视频中提取的

5.4 特征匹配

在对掌纹图像提取了丰富的特征描述后,采用特征点欧氏距离匹配的方式进行掌纹图像的特征匹配。首先,将两个待匹配掌纹图像的特征描述子分别记为

6 决策层级联融合

在进行特征提取和匹配后,对于每个用户可提取到掌脉模板特征T1、掌脉MF_LBP特征T2和掌纹局部不变特征T3。如前所述,这3种特征具有一定的互补性,因此在计算出三者的匹配分数SIM1、SIM2和SIM3后,如何有效地进行特征融合是本节的重点。在现有的生物特征融合研究中,常采用基于加权求和或是基于SVM的分数层融合策略,其流程如

图 7. 加权融合/SVM融合和级联融合的识别流程图。(a)加权融合/SVM融合;(b)级联融合

Fig. 7. Recognition flow charts of weighted fusion/SVM fusion and cascade fusion. (a) Weighted fusion/SVM fusion; (b) cascade fusion

7 仿真结果分析

由于目前的公开数据库中没有集掌纹、掌脉运动视频于一体的数据库,因此为了充分验证所搭建的掌纹掌脉联合识别系统的有效性,建立了一个双通道手掌运动视频数据库。自建的掌部数据库中采集了50位测试者的手掌运动视频,包含35位男性和15位女性,具有一定的代表性。对于每个测试者,分别采集其左右手掌,则数据库总共包含了100个手掌对象。对于每个手掌对象,在双通道摄像头下,分别采集了3段旋转视频和3段横扫视频作为数据库的数据源,同时每段视频中又包含可见光通道采集的掌纹视频和近红外通道采集的掌脉视频。因此,在构建的数据库中,掌脉视频数据有300段掌脉旋转视频和300段掌脉横扫视频,掌纹视频数据有300段掌纹旋转视频和300段掌纹横扫视频,共计1200段双通道手掌运动视频。算法的仿真平台为:Matlab R2015b,Microsoft Visual Studio 2013, CPU:Intel(R) Core(TM) i5-4590,RAM 12 GB。

7.1 仿真性能评价

通过类内匹配和类间匹配对算法性能进行评估。与现有掌纹掌脉系统的类内和类间匹配不同,本文类内匹配指的是同一手掌的横扫视频帧图像与旋转视频帧图像之间的相似度匹配,而类间匹配指的是不同手掌的横扫视频帧图像与旋转视频帧图像之间的相似度匹配。对于性能评价指标,使用错误接受率(FAR)、错误拒绝率(FRR)和等误率(EER)作为性能评价标准。FAR指的是在类间匹配时,不同的手掌对象被错误识别为相同手掌的次数占类间总匹配次数的比率;FRR指的是在类内匹配时,相同手掌被错误识别为不同手掌的次数占类内总匹配次数的比率。由FAR和FRR可形成工作特性(ROC)曲线,而EER则是ROC曲线中FAR与FRR相等时对应的值。使用EER可表征算法的准确率,EER值越小,则表示准确率越高。

7.2 级联融合对掌脉特征识别的影响

对于提取的掌脉模板特征T1和掌脉纹理特征T2,系统分别采用模板匹配算法和MF_LBP匹配算法

[

15

]

进行识别。该系统采用级联结构对T1和T2特征进行判别,因此可通过分别观察掌脉模板特征T1、掌脉纹理特征T2的相似度分布曲线以及将T1和T2特征级联融合后匹配分数的EER曲线来评估算法的性能。具体仿真结果如

图 8. 识别性能分布曲线。(a)模板匹配的相似度分数; (b) MF_LBP匹配的相似度分数;(c)等误率

Fig. 8. Distribution curves of recognition performance. (a) Similarity score of template matching; (b) similarity score of MF_LBP matching; (c) EER

从

表 1. 掌脉模板匹配、MF_LBP匹配和级联融合匹配的仿真结果

Table 1. Simulation results of template matching, MF_LBP matching and cascade fusion matching of palm vein

|

从

7.3 视频图像融合注册方式对掌纹识别性能的影响

上述掌纹识别步骤中采用了局部不变特征方法,为了进一步提升掌纹识别性能和丰富注册环节中的掌纹局部不变特征,提出旋转视频+横扫视频的视频图像融合注册方式。由于自建数据库中每个对象均包含1段掌纹旋转视频(记为Rot)和3段掌纹横扫视频(记为Swp1、Swp2和Swp3),因此新型视频图像融合注册方式形成的注册特征集总共有3种组合方式,分别为Rot+Swp1、Rot+Swp2和Rot+Swp3。另外,为了更好地验证新型融合注册方式的有效性,将单旋转视频和单横扫视频分别作为一种注册特征集,并进行比较,结果如

表 2. 多帧特征融合下识别等误率的对比

Table 2. Comparison of recognition equal error rate under multi-frame feature fusion

|

从

7.4 掌纹局部不变特征描述子对系统识别性能的影响

对于掌纹局部不变特征,使用第5.2节中提到的SIFT算法和FRDOH算法对掌纹进行特征提取,并从等误率和计算时间效率两个方面进行性能对比,结果如

图 9. SIFT算法与FRDOH算法性能对比结果。(a)识别等误率;(b)计算效率

Fig. 9. Performance comparison of SIFT and FRDOH. (a) Recognition equal error rate; (b) computational efficiency

从

7.5 不同特征融合方式比较

在掌纹掌脉联合识别的系统中,可以通过前面的仿真得到掌脉模板特征、掌脉纹理特征和掌纹局部不变特征的匹配分数。为了验证所提决策层级联融合策略的有效性,将其与SVM融合以及加权融合策略进行识别性能和时间消耗上的比较,其中性能比较结果如

同时,为了说明3种融合的时耗情况,分别记录对掌脉模板特征T1、掌脉纹理特征T2和掌纹局部不变特征T3的特征提取和匹配阶段的具体耗时,结果如

与数据库中的所有对象进行逐一匹配。而加权融合方式与SVM融合方式需提取所有的3个特征。因此,结合

根据第6节的决策层融合策略,分别从已注册用户和陌生人识别两种情况对级联融合方式的识别性能进行讨论。

由

表 3. 不同特征提取和匹配的耗时对比

Table 3. Time-consuming comparison of different feature extraction and matching

|

若是陌生人,则需要进行T1、T2和T3的识别才能获得结果,耗时

8 结论

为提升现有掌部特征识别系统的识别性能和增强系统的亲和性,提出了一种基于视频的掌纹掌脉联合识别系统。该系统通过采集运动视频来获取掌纹掌脉图像,将旋转视频和横扫视频联合组成注册集,使其包含多种运动形式的特征,充分利用多种特征间的相关性并以级联融合匹配的方式进行识别,从而增强系统的综合性能。为了验证所提方法的有效性,构建了一个包含100个手掌和1200段带有运动模糊的掌纹掌脉视频数据库,并在数据库上进行了大量仿真。结果显示系统在基本不影响准确率的情况下,能大幅提高已注册用户的识别速度,从而提升识别系统的亲和性。尽管仿真结果验证了系统的可行性和有效性,但由于时间限制,仿真数据库均是在夏季采集的手掌运动视频数据。在气温变化较大的情况下,仍需进一步验证识别系统的稳健性。在气温较低时,血管收缩会导致成像过程中静脉图像的不清晰,后续工作中需对这个问题进行更深入的研究,以提高系统的适应性。

[2] 李强, 裘正定, 孙冬梅, 等. 一种新的生物身份特征[J]. 自动化学报, 2007, 33(6): 596-601.

李强, 裘正定, 孙冬梅, 等. 一种新的生物身份特征[J]. 自动化学报, 2007, 33(6): 596-601.

Li Q, Qiu Z D, Sun D M, et al. A novel biometric: Knuckleprint[J]. Acta Automatica Sinica, 2007, 33(6): 596-601.

Li Q, Qiu Z D, Sun D M, et al. A novel biometric: Knuckleprint[J]. Acta Automatica Sinica, 2007, 33(6): 596-601.

[11] 赵珊, 王彪, 唐超颖. 基于链码表示的手臂静脉特征提取与匹配[J]. 光学学报, 2016, 36(5): 0515003.

赵珊, 王彪, 唐超颖. 基于链码表示的手臂静脉特征提取与匹配[J]. 光学学报, 2016, 36(5): 0515003.

[14] Qin W, Yin Y L, Liu L L. Video-based fingerprint verification[J]. Sensors, 2012, 13(9): 11660-11686.

Qin W, Yin Y L, Liu L L. Video-based fingerprint verification[J]. Sensors, 2012, 13(9): 11660-11686.

[17] Miura N, Nagasaka A, Miyatake T. Extraction of finger-vein patterns using maximum curvature points in image profiles[J]. IEICE Transactions on Information and Systems, 2007, E90D(8): 1185-1194.

Miura N, Nagasaka A, Miyatake T. Extraction of finger-vein patterns using maximum curvature points in image profiles[J]. IEICE Transactions on Information and Systems, 2007, E90D(8): 1185-1194.

Article Outline

王浩, 康文雄, 陈晓鹏. 基于视频的掌纹掌脉联合识别系统[J]. 光学学报, 2018, 38(2): 0215004. Hao Wang, Wenxiong Kang, Xiaopeng Chen. Palm Print and Palm Vein Joint Recognition System Based Video[J]. Acta Optica Sinica, 2018, 38(2): 0215004.