一种特征直线交会求解的姿态处理方法  下载: 911次

下载: 911次

1 引言

靶场光学姿态测量设备为高速姿态测量系统,具有准确的相机内、外参数,通常用于中远距离测量,目标成像相对较小,目标特征点比较集中,且在姿态变换过程中,分站可通视的同名特征点数量很少,故基于多特征点的处理方法[1-3]很难适用于靶场中远距离姿态测量;且分站没有准确的距离信息,故基于距离信息的单站姿态测量方法[4]也不适用。目前的处理方法大多基于多站交会处理,常用的处理方法为中轴线法[5]和模型匹配法[6-7]。前者直接利用平面中轴线与光心所在平面交会获取体中轴线,但只能获取偏航角和俯仰角,通常应用于导弹类成像轴对称目标;而后者首先需要根据目标精确尺寸建立目标模型,然后将模型的模拟投影元素(轮廓或区域)与实际投影结果匹配最优,可获取目标的偏航角、俯仰角和滚转角,该方法通常应用于飞机类非成像轴对称目标。模型匹配法必须建立准确的实体模型,中轴线法则不需建模,且在抗遮挡、像对特征匹配方面具有显著优势,是常用的姿态处理算法之一。

对于靶场多型飞机目标而言,首先测量单位不一定能拿到准确的外形数据,故模型匹配法的建模前提缺失;其次,在中远距离测量条件下,成像小则特征点相对集中,基于多特征点的处理方法不适用;最后,模型匹配法中物像对应关系的理论依据是共线方程,实际测量过程中,测量设备难免存在指向误差以及其他系统误差,导致物像匹配不对应,而基于方向计算的中轴线法受到测量设备指标内的指向误差影响较小,故本文拟对中轴线法进行拓展,利用飞机目标不相关直线矢量法求解目标姿态。

飞机类属于非投影轴对称目标,相对于弹体类目标,可提取的不相关直线特征较多。中轴线法不适用于飞机类目标的原因主要是目标主体轴线特征不显著,难于提取准确的中轴线;此外,没有明确分析出不同直线矢量承载不同姿态信息的支撑结论。本文通过对承载姿态信息的特征直线进行分类,提出一种在非中轴直线以外交会的姿态角信息求解方法。该方法同步结合了中轴线法及模型匹配法的优势,并利用直线特征矢量作为匹配元素,在精度得到有效保证的同时,显著提高处理效率。

2 特征直线构图关系及分类

2.1 飞机特征直线相对位姿关系构图

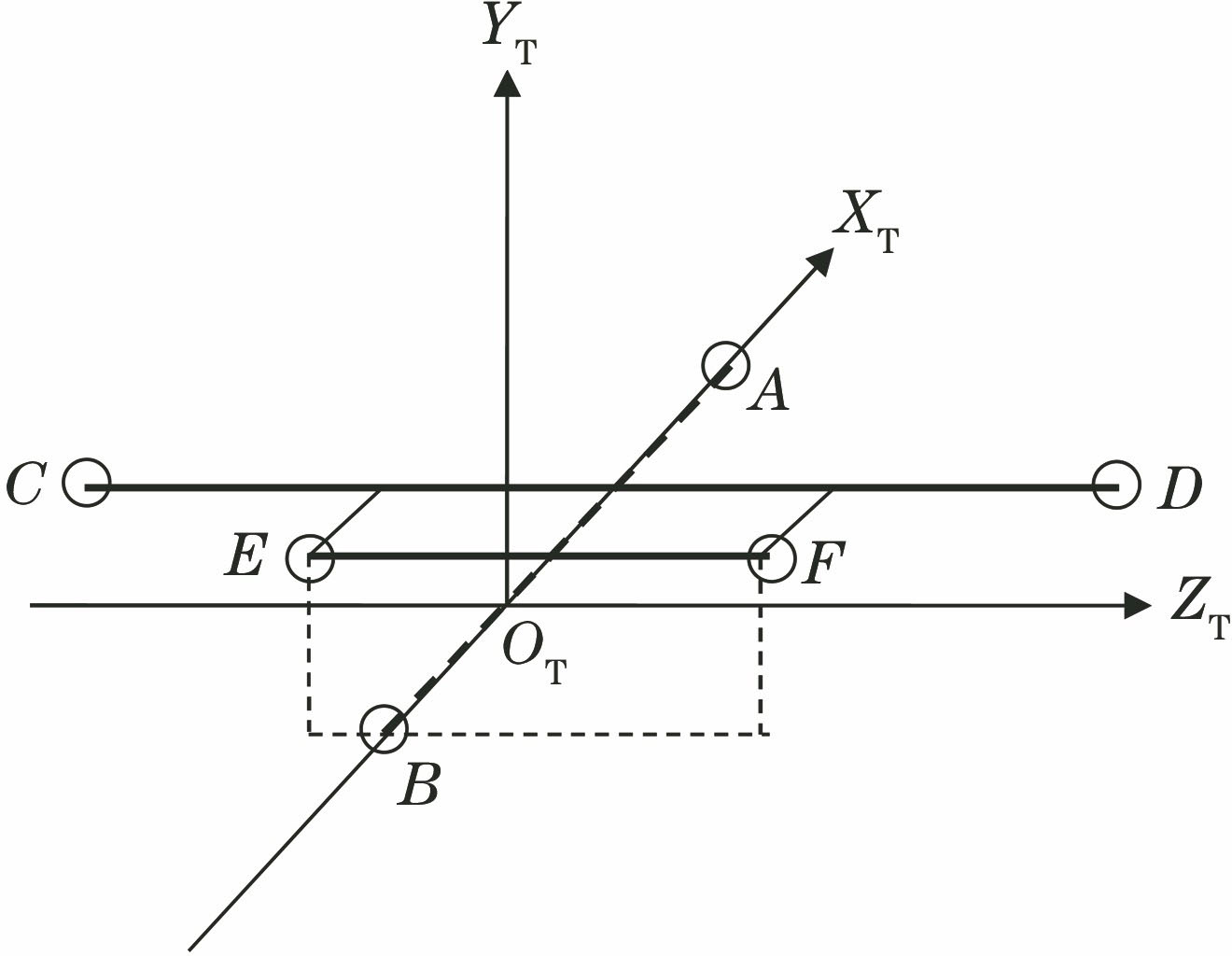

以w50型无人机为研究对象, 获取关键角点所成向量之间的相对位姿关系。

图 1. 特征直线相对位姿关系构图

Fig. 1. Composition of relative posture relations of characteristic lines

2.2 按照姿态承载信息差异进行特征直线归类

根据靶场系(基准系)下姿态角定义与欧拉角旋转的唯一对应顺序,可得到基准系下求解时刻相对初始时刻的姿态旋转基准矩阵R'=R(y,Ψ)R(z,φ)R(x,-γ),其中Ψ、φ、γ分别为目标体相对于基准系下的偏航角、俯仰角和滚转角。

通过对矩阵进行分析,可以发现在基准坐标系下,能携带姿态信息的关键直线矢量大致可分为如下两类:1)中轴线矢量或与之平行的直线矢量(平行于目标体坐标系XT轴),携带偏航角和俯仰角信息,本文算法中将其称为Ⅰ类直线;2)除Ⅰ类直线以外的直线矢量,本文算法中将其统称为Ⅱ类直线矢量,可携带3种姿态角信息。

3 算法分析

3.1 坐标系设置

算法过程中涉及的坐标系包括目标体坐标系、基准坐标系(通常取靶场坐标系)、摄像机坐标系、像面坐标系和像素坐标系。

1) 目标体坐标系OT-XTYTZT:按照零姿态定义,0°时目标体坐标系与基准坐标系平行,仅为原点之间的平移关系,故以此时的机身轴线为XT轴,机头为正;以机身垂直的连线为ZT轴,向右为正;按右手准则定义YT轴。

2) 基准坐标系O-XYZ:以靶场北向为X轴正向,靶场东向为Z轴正向,按右手准则定义Y轴。

3) 摄像机坐标系:为与基准坐标系保持一致,以像面中心为原点,以像面水平向右为Z轴正向,像面竖直向上为Y轴正向,以光轴指向为X轴正向。

4) 像面坐标系:Y轴、Z轴与摄像机坐标系保持一致,无X轴。

5) 像素坐标系:其与像面坐标系是仿射变换关系,图像原点在左上角,Y轴竖直向下,Z轴水平向右,以像素为单位。

3.2 算法推导

本文算法的已知条件如下:在目标体坐标系中,中轴线矢量为

解算过程:由于很难准确定位提取飞机类目标的机身像面轴线(影像非对称;机头、机身外形不规则),故暂不考虑Ⅰ类直线。若有其他与中轴线平行的直线易于提取,可直接采用轴线交会法获取偏航角和俯仰角信息,即采用下面所述的第1)步。

本文主要研究基于Ⅱ类直线的姿态信息获取方法。以垂直于中轴线的尾撑杆矢量

1) 采用面面交会法获取基准坐标系下求解时刻的尾撑杆矢量

2) 用修正的罗德里格斯(Rodrigues)变换实现动坐标系下的单次递进式旋转。由于姿态旋转变换是递进式旋转变换,故每一步旋转基准都是变化的。

根据Rodrigues旋转公式, V是一个三维空间向量,K(Kx,Ky,Kz)是旋转轴的单位向量,则V在右手螺旋定则意义下绕旋转轴K旋转角度θ得到的向量Vrot可以由三个不共面的向量V、K和K×V表示,即

其矩阵形式为

由此可得:

式中:E为单位矩阵。经过分析发现,本研究的应用场景与Rodrigues变换有差异,因此在第3)步中的旋转变换过程可表示为

3) 关键三矢量同步从物方空间至像方空间的递进式旋转变换。三矢量是指初始时刻平行于基准系X、Y、Z轴的目标体坐标系下的三矢量(XT-0,YT-0,ZT-0),作为旋转中重要过程矢量,其中XT-0∥

第一步,偏航Ψ角,旋转轴为YT-0(0,1,0),同步计算出XT-0、ZT-0经旋转后得到XT-1和ZT-1(经第一步旋转后的目标X轴、Z轴);

第二步,俯仰φ角,旋转轴为ZT-1,同步计算出XT-1和YT-0经旋转后所得XT-2和YT-1(经第二步旋转后的目标X轴、Y轴);

第三步,滚转γ角,旋转轴为XT-2,根据Rodrigues变换公式,旋转前向量为ZT-1(-sinΨ,0,cosΨ)T,旋转后向量为第1)步交会出的矢量(l',m',n')T,则旋转角度为

旋转轴K为旋转前、后向量的叉积,即

按照右手定则

则旋转矩阵Rγ为

则

式中:k=[(m'cosψ)2+(n'sinψ+l'cosψ)2+(m'×sinψ)-1/2。

对比(1)式和(10)式,可得

附加约束条件为(11)式中各列相互正交。

第四步,利用其他非相关直线进行优化求解。

4 算法验证

为了验证本文算法的精度,利用w50型无人机按照预定的航迹飞行进行验证,使用姿态经纬仪实时采集大量动态图像数据。利用目前的处理系统-模型匹配法,以及本文方法同步进行处理,其中相对真值由遥测机载数据提供,采用GPS与惯导组合测量姿态数据,测量精度远高于光学测量基准,已经过多次检定和校飞试验验证。序列图像中的分站对应图像如

图 2. 序列图像中的分站对应图像。(a)分站1图像;(b)分站2图像

Fig. 2. Sub-station images from sequence images. (a) Sub-station 1; (b) sub-station 2

图 3. 模型匹配法和本文方法的姿态结果对比。 (a)偏航角结果对比;(b)俯仰角结果对比;(c)滚转角结果对比

Fig. 3. Comparison of pose results between classified linear analysis methods and proposed method. (a) Comparison of yaw angle; (b) comparison of pitch angle; (c) comparison of roll angle

从正确性分析可知,本文方法更可靠、更稳定,与遥测数据吻合较好。通过方均根误差分析,本文方法的偏航角、俯仰角和滚转角分别为0.32°、0.27°和0.49°,而模型匹配方法的3种角度均接近1°。从处理效率上分析,模型匹配方法需要经过前期建模与后期特征提取、匹配修正等过程,本文方法只需提取分站的同名特征直线矢量,不需要建模,且在后期特征提取、匹配方面更有优势,故处理效率得到了提高。

5 数据误差分析

5.1 直线端点定位误差的影响分析

斜率来源于面轴线提取,而轴线提取主要取决于关键点的定位精度,故直接分析端点定位误差与最终姿态角的对应关系;为了进一步弄清不同成像情况下端点定位误差对面轴线提取斜率的影响,对面轴线提取精度与k值变化量之间的关系进行分析。

以

像素定位误差设定为

表 1. 分站1成像情况

Table 1. Imaging situation at sub-station 1

|

从

图 4. 姿态角误差与像素提取误差的关系。(a)偏航角误差与像素提取误差的关系;(b)像素提取误差与k值变化量的关系

Fig. 4. Relationship between attitude angle error and endpoint location error. (a) Relationship between yaw angle error and endpoint location error; (b) relationship between endpoint location error and k variation

5.2 方向矢量不准确与姿态角误差的关系

经过算法检验,Ⅱ类直线中平行于

图 5. 方向矢量不准确对姿态角误差的影响

Fig. 5. Effect of inaccuracy of direction vector on attitude angle error

从

综上,姿态角误差影响因素按照重要程度依次为方向矢量测量误差、像长、直线矢量提取误差,焦距测量误差和光轴指向误差可忽略不计。需要对方向矢量测量误差影响进行分类分析,其中与中轴线垂直的直线与尺寸无关,其他直线对姿态角影响很大,尤其对偏航角误差的影响最大。

6 结论

通过对目标姿态定义与欧拉角递进旋转的唯一对应性进行分析,推导出唯一对应姿态旋转矩阵,总结出不同直线承载不同姿态信息的结论;提出一种将特征直线矢量交会处理作为旋转变换条件输入,利用改进的Rodrigues矩阵获取关键旋转矩阵,最后获取3种姿态角的方法。该方法结合交会处理及投影匹配的优势,兼顾处理精度及效率,并在无模型输入、中轴线特征提取不准确的情况下,得到可靠的飞机类3种姿态角信息,普遍适用于成像轴对称及非轴对称目标的姿态角处理。

[1] 刘进博, 郭鹏宇, 李鑫, 等. 基于点对应的相机姿态估计算法性能评价[J]. 光学学报, 2016, 36(5): 0515002.

[2] 王鲲鹏, 张小虎, 于起峰. 基于目标特征点比例的单站图像定姿方法[J]. 应用光学, 2009, 30(6): 974-978.

[3] 朱帆, 于芳苏, 吴易明, 等. P4P法相机姿态标定精度分析[J]. 光学学报, 2018, 38(11): 1115005.

[4] 胡小丽, 张玉伦, 刘彪, 等. 基于物距辅助的单站姿态处理方法[J]. 光学学报, 2019, 39(6): 0612004.

[5] 于起峰, 孙祥一, 陈国军. 用光测图像确定空间目标俯仰角和偏航角的中轴线法[J]. 国防科技大学学报, 2000, 22(2): 15-19.

Yu Q F, Sun X Y, Chen G J. A new method of measure the pitching and yaw of the axes symmetry object through the optical image[J]. Journal of National University of Defense Technology, 2000, 22(2): 15-19.

[6] 习飞, 文贡坚, 蔡伟柯. 利用三维模型和立体像对估算飞行目标位姿[J]. 计算机仿真, 2007, 24(11): 95-99, 143.

Xi F, Wen G J, Cai W K. Estimating pose parameters of flying object by using model and stereo images[J]. Computer Simulation, 2007, 24(11): 95-99, 143.

[7] 苏国中. 基于光电经纬仪影像的飞机姿态测量方法研究[D]. 武汉: 武汉大学, 2005.

Su GZ. Research on the method of aircraft pose surveying from image sequences obtained by photoelectric theodolite[D]. Wuhan: Wuhan University, 2005.

Article Outline

胡小丽, 唐明刚, 吴海英. 一种特征直线交会求解的姿态处理方法[J]. 激光与光电子学进展, 2020, 57(9): 091203. Xiaoli Hu, Minggang Tang, Haiying Wu. A Pose Information Acquisition Method Based on Characteristic Line Intersection Analysis[J]. Laser & Optoelectronics Progress, 2020, 57(9): 091203.