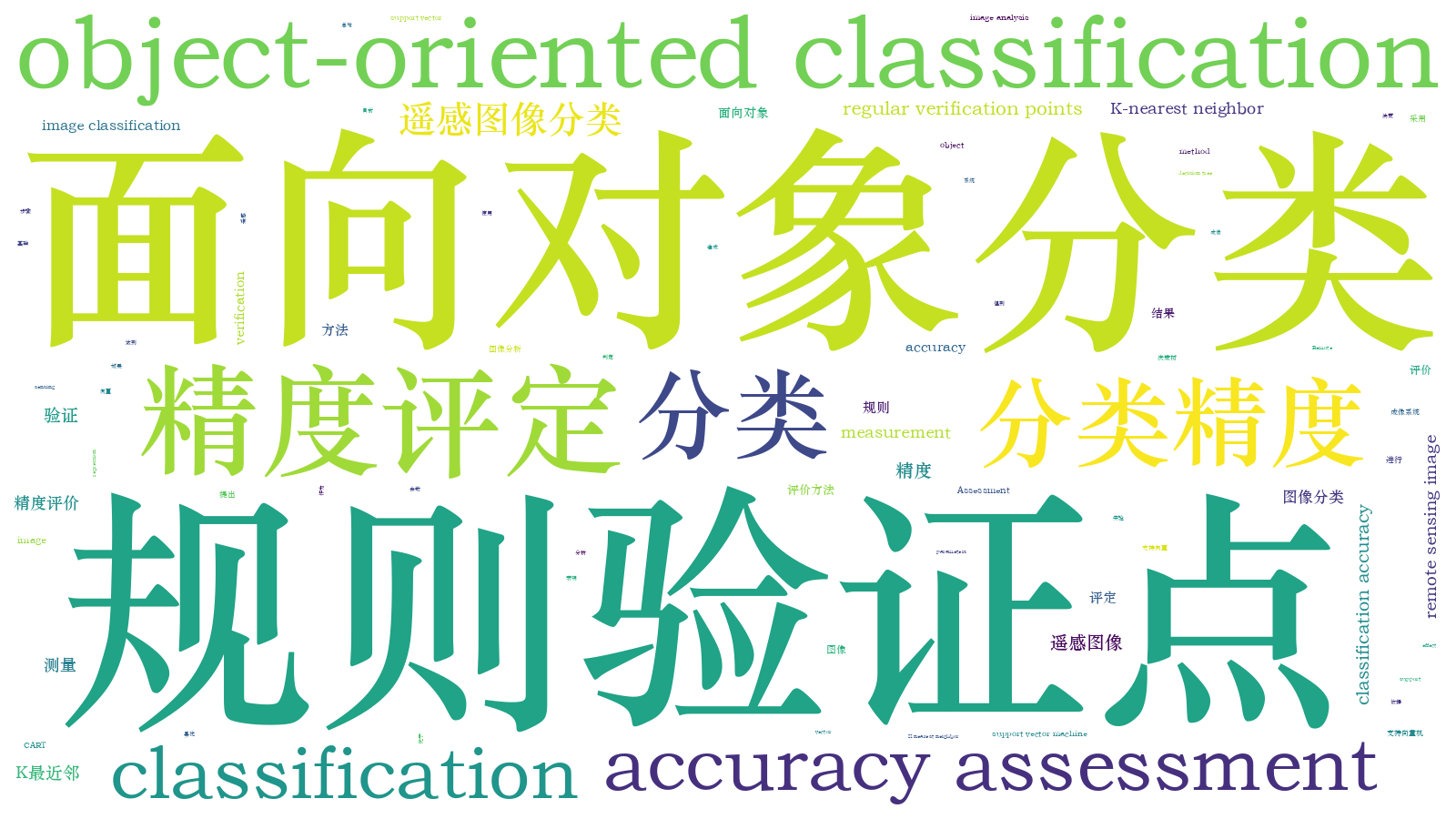

基于规则验证点的面向对象分类精度评价  下载: 932次

下载: 932次

1 引言

遥感图像分类是遥感应用的基础,其广泛应用于国土调查、城市规划、生态环保和自然灾害监测等领域[1-2]。随着遥感技术的不断进步,高分辨率遥感图像可提供的特征信息越来越丰富,如几何特征、光谱特征和纹理特征等。传统基于像素的分类方法存在“同物异谱”及“同谱异物”的问题,造成分类结果细碎且精度不高,已经不能满足高分辨率遥感图像信息提取的要求。面向对象分类方法因其具有良好的平滑性和较高的分类精度,已经成为遥感图像分类的研究热点[3-7]。

马燕妮等[8]将尺度估计方法应用于分形网络演化分割,该方法不需要使用先验知识,且在分割前就可以自适应地估计出相对较为合适的尺度参数,能够提高面向对象信息提取的自动化程度。雷钊等[9]提出了一种面向对象构建决策树的建筑点云高精度提取方法,该方法从机载激光点云数据中提取建筑物点的准确率高达96%。梁林林等[10]利用无人机高空间分辨率图像和面向对象分类技术进行了黑河上游俄博岭垭口冻土区热融滑塌监测实验,详细分析了最邻近、K最邻近、决策树、支持向量机和随机森林5种面向对象的监督学习方法提取冻土热融滑塌边界的性能和精度。Jin等[11]提出了一种将面向对象分类与深度卷积神经网络相结合的方法,并以覆盖抚仙湖周边地区的遥感图像为例,对10种土地类型进行了分类。结果表明所提方法能够有效解决典型特征分类不准确的问题,其分类精度明显高于深度卷积神经网络方法。

目前针对面向对象分类结果的精度评定方法常采用随机验证样本点,但该评价方法往往会出现样本分布不均匀的情况。假如样本点在被错误分类的对象上分布过多,而在被正确分类的对象上分布较少,这容易造成较大的精度评定误差,从而导致评定结果与分类效果不匹配。为此,本文提出基于规则验证点的面向对象分类的精度评价方法,并将支持向量机(SVM)、CART(classification and regression tree)决策树和K最近邻(KNN)等面向对象的分类方法的结果与基于随机验证点的方法的结果进行比较。

2 基于规则验证点的面向对象分类的精度评价方法

面向对象分类的前提是对高分辨率遥感图像进行分割,分割的好坏直接关系到面向对象分类的精度的高低[5]。本文使用eCognition软件中比较成熟的多尺度分割方法进行实验,通过对比实验发现,当分割尺度为40时,分割效果较好。采用面向对象分类中最常用的三种分类方法即 SVM、CART决策树和KNN对遥感图像进行分类[12-13]。

在对面向对象分类的结果进行精度评价中,需要建立验证点[5]。传统的方法是通过导入原始图像建立矢量文件和随机验证点,将所得结果与分类后图像合并导入eCognition软件中,再对分类后结果进行精度评定。本文提出采用规则验证点进行精度评定,首先将验证点平均分布在图像的规则网格中,然后对每个验证点的属性进行命名。通过波段组合、创建样本点和选择验证点个数等步骤生成矢量文件和规则网格,从而完成规则验证点的创建。最后将创建的规则验证点导入eCognition软件中,通过分割参数的选择、分割对象、选取训练样本和选择分类器等步骤完成分割和分类等操作,从而采用规则验证点对面向对象分类的结果进行精度评定。

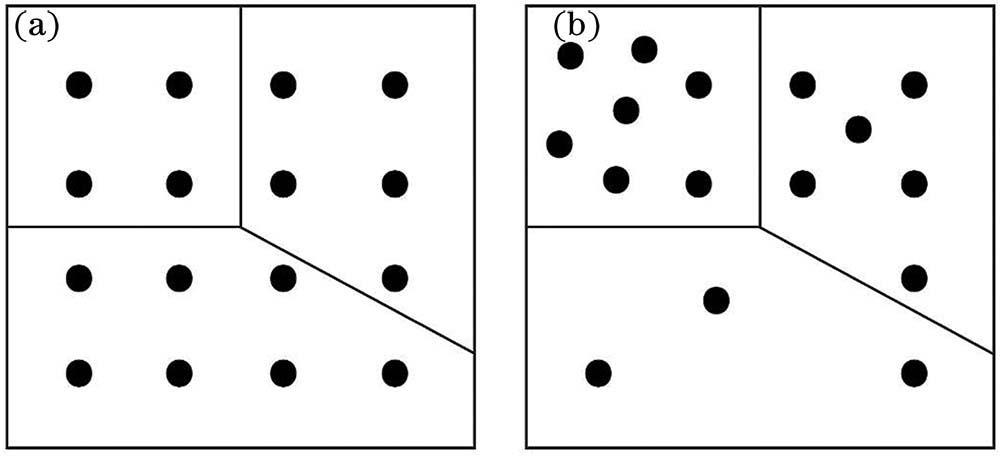

规则验证点和随机验证点的对比示意图如

图 1. 规则验证点和随机验证点对比示意图。(a)规则验证点;(b)随机验证点

Fig. 1. Diagrams of regular verification points and random verification points. (a) Regular verification points; (b) random verification points

3 实验设计

3.1 实验数据

本文采用某城市郊区的高分二号遥感图像作为数据源,其空间分辨率为1 m,图像拍摄时间为2015年3月21日,研究数据为经过大气校正、几何校正等处理后的数据。研究区域为800 pixel×800 pixel的区域,图像中的地物类别包括道路、植被、建筑、水体和裸地5类,参与分类的波段为红(R)、绿(G)、蓝(B)、近红外(NIR),实验得到的高分二号(GF-2)融合图像如

3.2 实验比较

在对面向对象分类的结果评价中,需要建立验证样本点以对分类结果进行精度评定。本文分别采用规则验证点和随机验证点进行实验,并对面向对象分类中常用的SVM、CART决策树和KNN等方法进行比较。在本实验中,SVM采用径向基核函数(RBF),其中C惩罚系数为2,KNN的最近邻距离的取值为1。

为了对精度评定结果进行系统的比较,分别将验证点的数量(N)设置为50,100,150,200,250,300,其中规则验证点的创建效果如

图 3. 规则验证点创建。(a) N=50;(b) N=100;(c) N=150;(d) N=200;(e) N=250;(f) N=300

Fig. 3. Creation of regular verification points. (a) N=50; (b) N=100; (c) N=150; (d) N=200; (e) N=250; (f) N=300

4 实验结果与分析

将SVM、CART决策树和KNN用于遥感图像分类,并采用规则验证点和随机验证点分别对分类结果进行精度评定。三种分类方法在不同数量验证点情况下所得的总体分类精度(OA)和Kappa系数分别如

从

表 1. 不同数量验证点下的SVM分类结果

Table 1. SVM classification results under different numbers of verification points

|

表 2. 不同数量验证点下的CART决策树分类结果

Table 2. CART decision tree classification results under different numbers of verification points

|

为87.92%、 Kappa系数为0.810,而基于随机验证点的方法的总体分类精度为86.36%、Kappa系数为0.801。在实验过程中,随着验证点数量的变化,不同验证点的总体分类精度和Kappa系数波动较大,其中基于规则验证点的方法的总体分类精度和Kappa系数分别变化了22.82个百分点和0.370,基于随机验证点的方法的总体分类精度和Kappa系数分别变化了40.06个百分点和0.596,这说明基于随机验证点的方法的结果受验证点数量变化的影响更大。面向对象分类是以对象为基础的分类方法,随着验证点在同一对象上分布密度的上升,错误分类增加了分类后精度降低的概率。当验证点数量超过200时,总体分类精度和Kappa系数呈下降趋势,因此,在实验过程中应选择最佳验证点数量。

表 3. 不同数量验证点下的KNN分类结果

Table 3. KNN classification results under different numbers of verification points

|

由

由

为了进一步比较SVM、CART决策树和CNN三种方法的分类结果,作出三种方法的最优分类精度图(

图 4. 三种方法的分类结果比较。(a)总体分类精度;(b) Kappa系数

Fig. 4. Comparison of classification results of three methods. (a) Overall classification accuracy; (b) Kappa coefficient

5 结论

与仅利用光谱信息的基于像素的分类方法相比,面向对象分类方法综合考虑了图像的光谱、空间和纹理等多种特征信息,对边界模糊、类型复杂多样的遥感图像具有更好的识别能力,能够较好地提高分类精度。其中精度评定是评价分类效果的重要指标,采用随机验证点对面向对象分类的结果进行精度评定时容易造成评定的分类精度不高。采用SVM、CART决策树和KNN三种分类方法对遥感图像进行面向对象分类,并在不同数量的验证点下分别利用基于规则验证点和随机验证点的方法对分类结果进行精度评定。实验结果表明,不论验证点的数量如何变化,所提方法均比基于随机验证点的方法得到的分类精度更高,且所提方法受验证点数量变化的影响更小,三种分类方法在规则验证点下的最优总体分类精度分别达到了87.92%、91.94%和94.63%。

[2] Gong X Q, Shen L, Lu T D. Refining training samples using median absolute deviation for supervised classification of remote sensing images[J]. Journal of the Indian Society of Remote Sensing, 2019, 47(4): 647-659.

[5] 孙坤, 鲁铁定. 顾及多尺度分割参数的FNEA面向对象分类[J]. 测绘通报, 2018( 3): 43- 48.

SunK, Lu TD. Research on FNEA object-oriented classification based on multi-scale partition parameters[J]. Bulletin of Surveying and Mapping, 2018( 3): 43- 48.

[6] 王民, 樊潭飞, 贠卫国, 等. PFWG改进的CNN多光谱遥感图像分类[J]. 激光与光电子学进展, 2019, 56(3): 031003.

[7] 王艳琦, 秦福莹, 银山, 等. 基于GF-1卫星数据与面向对象分类的达里诺尔湿地自然保护区土地覆盖信息提取[J]. 中国农学通报, 2019, 35(10): 137-141.

Wang Y Q, Qin F Y, Yin S, et al. Land cover information extraction of dalinuoer wetland nature reserve: Based on GF-1 satellite data and object-oriented classification[J]. Chinese Agricultural Science Bulletin, 2019, 35(10): 137-141.

[8] 马燕妮, 明冬萍, 杨海平. 面向对象影像多尺度分割最大异质性参数估计[J]. 遥感学报, 2017, 21(4): 566-578.

Ma Y N, Ming D P, Yang H P. Scale estimation of object-oriented image analysis based on spectral-spatial statistics[J]. Journal of Remote Sensing, 2017, 21(4): 566-578.

[9] 雷钊, 习晓环, 王成, 等. 决策树约束的建筑点云提取方法[J]. 激光与光电子学进展, 2018, 55(8): 082803.

[10] 梁林林, 江利明, 周志伟, 等. 无人机遥感影像面向对象分类的冻土热融滑塌边界提取[J]. 国土资源遥感, 2019, 31(2): 180-186.

Liang L L, Jiang L M, Zhou Z W, et al. Object-oriented classification of unmanned aerial vehicle image for thermal erosion gully boundary extraction[J]. Remote Sensing for Land & Resources, 2019, 31(2): 180-186.

[11] Jin B X, Ye P, Zhang X Y, et al. Object-oriented method combined with deep convolutional neural networks for land-use-type classification of remote sensing images[J]. Journal of the Indian Society of Remote Sensing, 2019, 47(6): 951-965.

[12] 陈丽萍, 孙玉军. 基于不同决策树的面向对象林区遥感影像分类比较[J]. 应用生态学报, 2018, 29(12): 3995-4003.

Chen L P, Sun Y J. Comparison of object-oriented remote sensing image classification based on different decision trees in forest area[J]. Chinese Journal of Applied Ecology, 2018, 29(12): 3995-4003.

[13] 杨斌, 王翔. 基于深度残差去噪网络的遥感融合图像质量提升[J]. 激光与光电子学进展, 2019, 56(16): 161009.

龚循强, 刘星雷, 鲁铁定, 刘丹. 基于规则验证点的面向对象分类精度评价[J]. 激光与光电子学进展, 2020, 57(24): 241102. Xunqiang Gong, Xinglei Liu, Tieding Lu, Dan Liu. Accuracy Assessment of Object-Oriented Classification Based on Regular Verification Points[J]. Laser & Optoelectronics Progress, 2020, 57(24): 241102.